Apple ha introdotto con discrezione Ferret LLM, un modello linguistico multimodale tutt’altro che ordinario. Questo lancio silenzioso si discosta dalla norma fondendo la comprensione del linguaggio con l’analisi delle immagini, ridefinendo la portata delle capacità dell’intelligenza artificiale.

Rilasciato in sordina su GitHub, Ferret LLM rappresenta il sottile passo avanti di Apple verso l’apertura, invitando sviluppatori e ricercatori a svelarne il potenziale. Tuttavia, durante il suo lancio, si profilano sfide nel ridimensionare Ferret rispetto a modelli più grandi, ponendo ostacoli legati alle infrastrutture. Tuttavia, il potenziale impatto di Ferret sui dispositivi Apple è considerevole, promettendo una nuova dimensione nelle interazioni degli utenti e una comprensione più profonda dei contenuti visivi. Vuoi saperne di più? Abbiamo raccolto tutto ciò che devi sapere sull’ultima mossa di Apple nel panorama dell’intelligenza artificiale.

Cos’è Apple Ferret LLM?

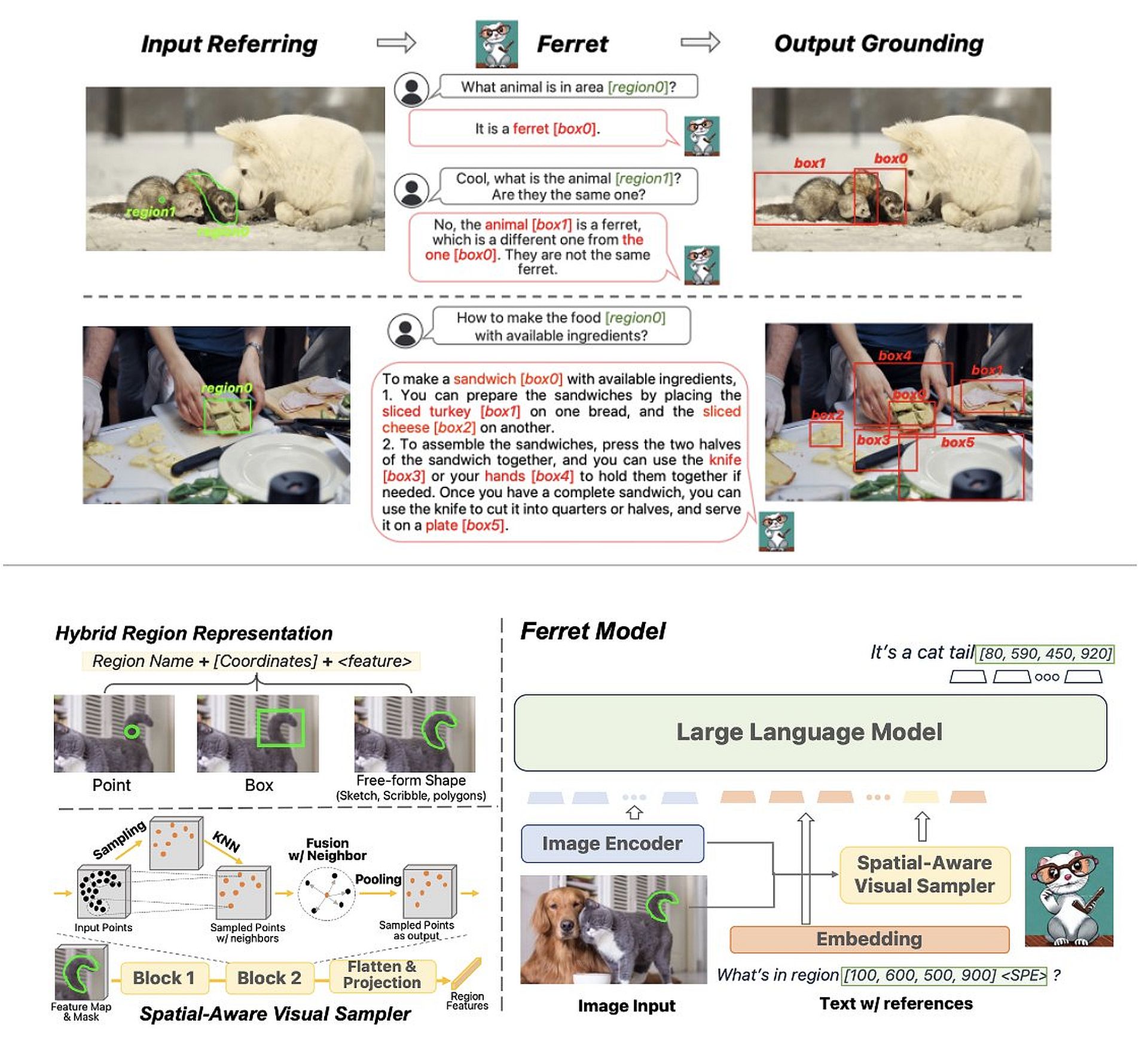

Ferret, un modello LLM multimodale open source sviluppato da Apple Inc. in collaborazione con la Cornell University, si distingue per la sua integrazione unica della comprensione del linguaggio con l’analisi delle immagini. Rilasciato il GitHubsi discosta dai modelli linguistici tradizionali incorporando elementi visivi nella sua elaborazione.

Ecco come funziona Apple Ferret LLM:

- Integrazione visiva: Ferret non si limita alla comprensione testuale ma analizza specifiche regioni delle immagini, individuando elementi al loro interno. Questi elementi vengono quindi utilizzati come parte di una query, consentendo a Ferret di rispondere a richieste che coinvolgono sia testo che immagini.

- Risposte contestuali: Ad esempio, quando gli viene chiesto di identificare un oggetto all’interno di un’immagine, Ferret non solo riconosce l’oggetto ma sfrutta gli elementi circostanti per fornire informazioni o contesto più profondi, andando oltre il semplice riconoscimento dell’oggetto.

Zhe Gan, uno scienziato ricercatore sull’intelligenza artificiale di Apple, ha evidenziato la capacità di Ferret di fare riferimento e comprendere gli elementi all’interno delle immagini a vari livelli di dettaglio. Questa flessibilità consente a Ferret di comprendere query che coinvolgono contenuti visivi complessi.

Ciò che distingue l’introduzione di Ferret è la sua abilità tecnologica e il passo strategico di Apple verso l’apertura. Partendo dalla sua natura tipicamente protetta, Apple ha scelto di rilasciare Ferret come open source modello. Questo spostamento verso la trasparenza implica un approccio collaborativo, invitando contributi e promuovendo un ecosistema in cui ricercatori e sviluppatori a livello globale possono migliorare, perfezionare ed esplorare le capacità del modello

Sfide future

L’emergere del furetto preannuncia una nuova era nell’intelligenza artificiale, in cui la comprensione multimodale diventa la norma anziché l’eccezione. Le sue capacità aprono le porte a una miriade di applicazioni in diversi campi, dall’analisi avanzata dei contenuti alle innovative interazioni uomo-intelligenza artificiale.

Tuttavia, Apple deve affrontare sfide nel ridimensionare Ferret a causa delle limitazioni dell’infrastruttura, sollevando dubbi sulla sua capacità di competere con giganti del settore come GPT-4 nell’implementazione di modelli linguistici su larga scala. Questo dilemma richiede decisioni strategiche, che potrebbero coinvolgere partenariati o abbracciare ulteriormente i principi open source per sfruttare competenze e risorse collettive.

Per informazioni più dettagliate su Apple Ferret LLM, visitare la sua pagina arXiv.

Il potenziale impatto di Apple Ferret LLM su iPhone e altri dispositivi Apple

L’introduzione di Ferret LLM di Apple potrebbe potenzialmente avere un impatto significativo su vari prodotti Apple, in particolare nel miglioramento dell’esperienza utente e delle funzionalità nei seguenti modi:

Interazioni basate su immagini migliorate

L’integrazione dell’analisi delle immagini di Apple Ferret LLM all’interno di Siri potrebbe consentire interazioni più sofisticate e contestuali. Gli utenti potrebbero essere in grado di porre domande sulle immagini o richiedere azioni basate sul contenuto visivo.

Le capacità di Ferret potrebbero potenziare funzionalità avanzate di ricerca visiva all’interno dell’ecosistema Apple. Gli utenti possono cercare elementi o informazioni all’interno delle immagini, offrendo un’esperienza di ricerca più intuitiva e completa.

Assistenza utente aumentata

La capacità del furetto di interpretare le immagini e fornire informazioni contestuali potrebbe apportare grandi vantaggi agli utenti con esigenze di accessibilità. Potrebbe aiutare a identificare oggetti o scene per utenti ipovedenti, migliorando le loro interazioni quotidiane con i dispositivi Apple.

L’integrazione di Ferret potrebbe migliorare le capacità di ARKit di Apple, consentendo esperienze di realtà aumentata più sofisticate e interattive basate sulla comprensione delle immagini e sulle risposte contestuali.

Migliore comprensione dei media e dei contenuti

Ferret potrebbe migliorare l’organizzazione e le funzionalità di ricerca all’interno dell’app Foto riconoscendo e indicizzando elementi specifici all’interno di immagini e video, consentendo una categorizzazione e una ricerca più intelligenti.

Sfruttando la comprensione dell’immagine di Ferret, Apple potrebbe offrire consigli sui contenuti più personalizzati basati sulle interazioni degli utenti con i contenuti visivi nel suo ecosistema.

Innovazione degli sviluppatori

Gli sviluppatori potrebbero sfruttare le capacità di Ferret per creare applicazioni innovative in vari settori, dall’istruzione all’assistenza sanitaria, incorporando immagini avanzate e comprensione del linguaggio nelle loro app.

Tuttavia, l’implementazione delle capacità di Ferret nei prodotti Apple dipenderebbe da vari fattori, tra cui la fattibilità tecnologica, considerazioni sulla privacy degli utenti e il grado di integrazione nel software e nell’hardware Apple esistenti. Inoltre, le decisioni strategiche di Apple riguardanti la scalabilità e l’implementazione di Ferret all’interno della sua linea di prodotti determineranno l’impatto effettivo sulle caratteristiche e funzionalità rivolte al consumatore.

Credito immagine in primo piano: Jhon Paul Dela Cruz/Unsplash