Preparati a entrare in un mondo di pura immaginazione, perché Google Genie è arrivato per trasformare i tuoi sogni in realtà virtuale!

La settimana scorsa OpenAI ha incantato tutti noi con il suo strumento avanzato di generazione video, Sora AIe ora l’innovativo modello di intelligenza artificiale di Google trasforma semplici immagini in ambienti virtuali completamente riproducibili.

Sì, ora puoi creare un file intero gioco platform 2D con un semplice movimento del polso (o almeno un tocco della tastiera).

Tim RocktäschelTeam Leader dell’Open Endedness presso Google Mente profondaha annunciato la nascita di Google Genie su X con le seguenti parole:

Sono davvero entusiasta di rivelare cosa @GoogleDeepMindIl team Open Endedness di è stato all’altezza

. Presentiamo Genio

un modello di mondo di base formato esclusivamente da video Internet in grado di generare una varietà infinita di mondi 2D controllabili dall’azione grazie a suggerimenti di immagini. pic.twitter.com/TnQ8uv81wc

— Tim Rocktäschel (@_rockt) 26 febbraio 2024

Cos’è Google Genie?

La progettazione di giochi tradizionale spesso richiede competenze di codifica complesse. Con Google Genie le barriere tecniche vengono notevolmente ridotte. L’intelligenza artificiale gestisce gli intricati processi di trasformazione della tua idea in un ambiente virtuale giocabile, permettendoti di concentrarti sulla pura gioia della creazione.

Google Genie è in prima linea nella tecnologia AI, classificata come “modello mondiale di fondazione“.

Ciò significa che è stato addestrato su un enorme set di dati di video Internet, in particolare quelli che mostrano il gameplay. Attraverso questa formazione, Genie sviluppa una profonda comprensione di come funzionano gli ambienti e di come i giocatori interagiscono tipicamente con essi.

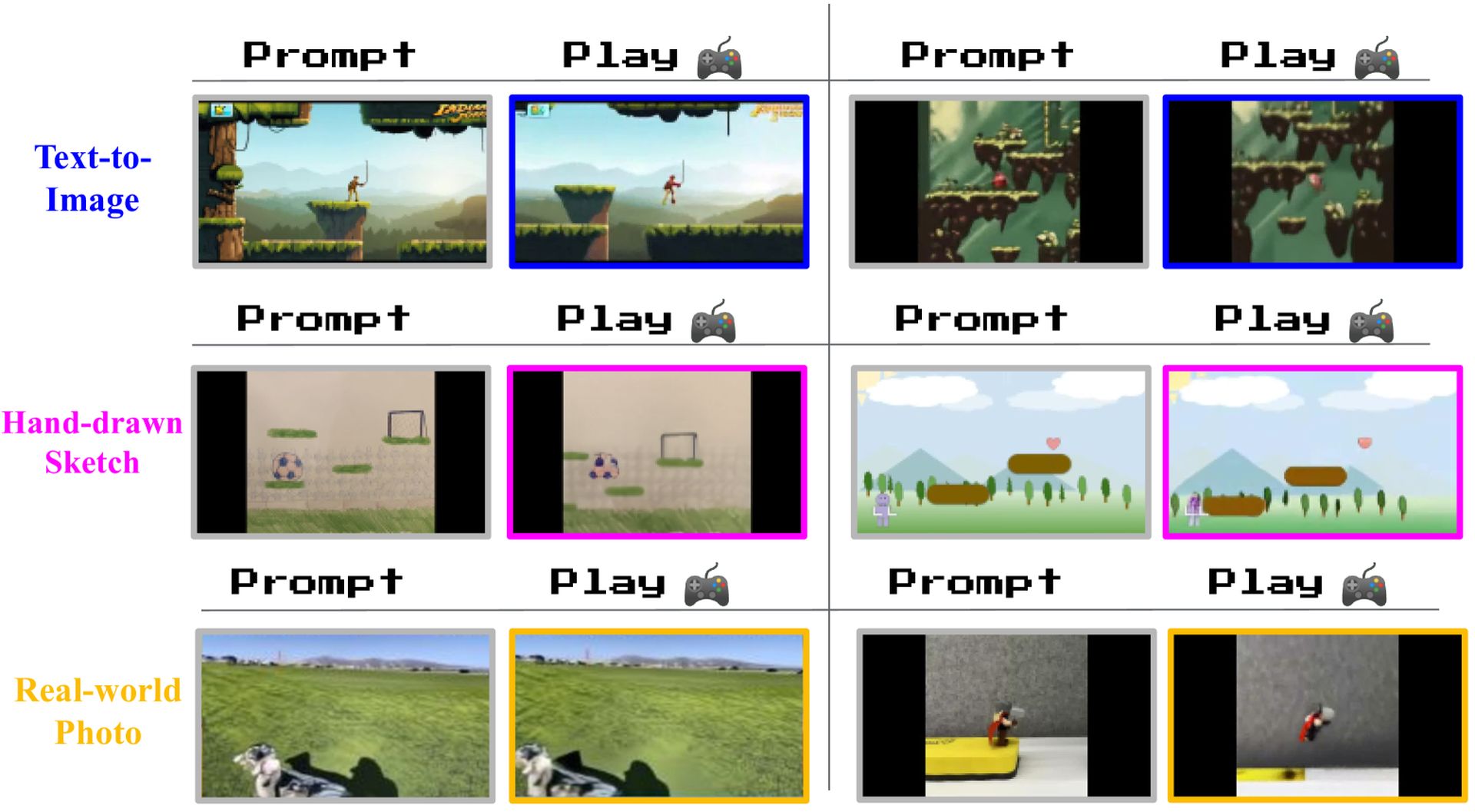

Pensa a Google Genie come al tuo assistente personale per lo sviluppo di giochi. Tutto quello che devi fare è fornire un punto di partenza e questo potrebbe essere:

- UN Immagine

- UN descrizione scritta

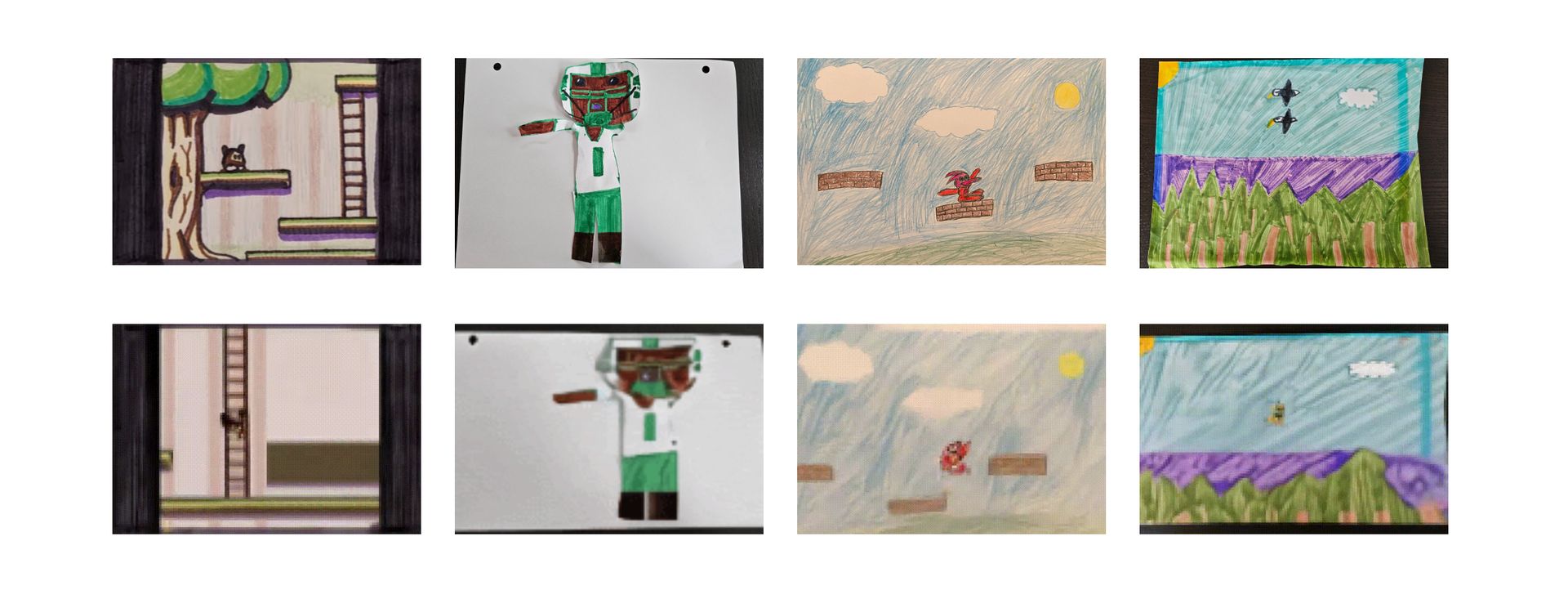

- UN semplice schizzo disegnato a mano

Google Genie prende quindi il tuo input e utilizza il suo potere creativo per creare uno spazio virtuale unico e completamente giocabile.

La vera magia qui è che Google Genie impara a creare mondi virtuali controllabili senza istruzioni di gioco specifiche. Analizza i video per comprendere le regole di base degli ambienti e con cosa i giocatori possono interagire. Sorprendentemente, ciò consente schemi di controllo coerenti anche in mondi totalmente nuovi generati dall’intelligenza artificiale.

La magia di Google DeepMind

Google DeepMind riesce a stupirci con quasi tutto ciò che fa e Google Genie non fa eccezione.

Il cervello di Google Genie è costruito su un tipo speciale di trasformatore chiamato a trasformatore spaziotemporale (ST).. A differenza dei normali trasformatori progettati per il testo, i trasformatori ST sono specificatamente sintonizzati per comprendere i video. Prestano attenzione a ciò che accade all’interno di ogni singolo fotogramma (attenzione spaziale) e anche a come le cose cambiano nel tempo attraverso più fotogrammi (attenzione temporale). Ciò li rende molto più bravi a gestire i complessi schemi presenti nelle immagini in movimento.

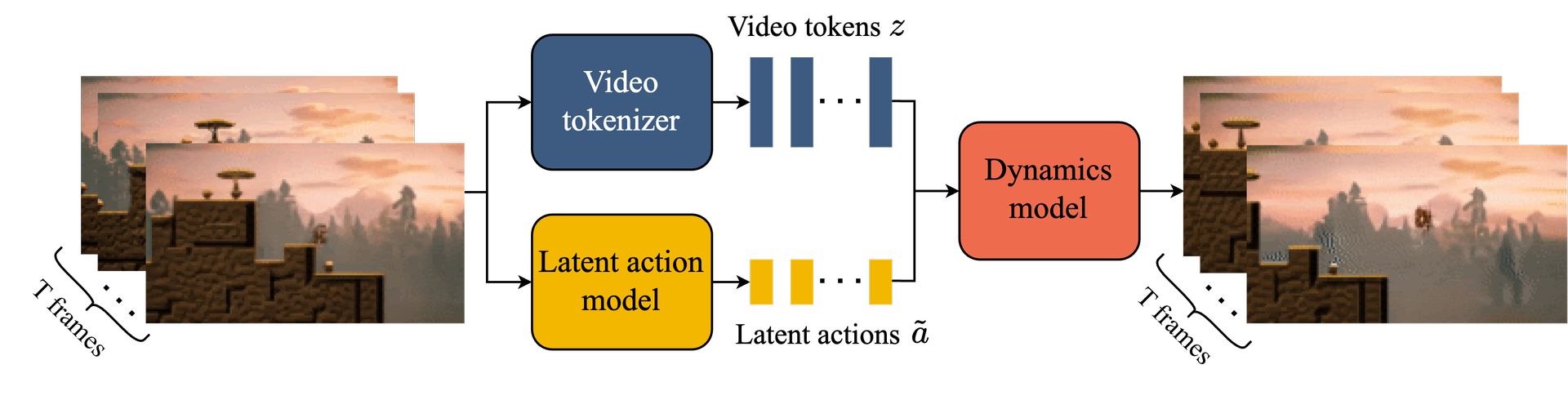

I video sono costituiti da tonnellate di pixel, il che può essere molto da gestire per un modello. Genio utilizza un tokenizzatore video per schiacciare quei fotogrammi pieni di pixel in blocchi più piccoli e più facili da elaborare chiamati token. Immaginatelo come tradurre un intero film in una serie di simboli chiave. Questa semplificazione rende l’intero processo di generazione del video più fluido e veloce.

Il LAM è come un detective all’interno di Google Genie. Guarda i video e cerca di capire le azioni non dette che si verificano tra i fotogrammi. Questo è importante perché se vuoi controllare come viene riprodotto un video generato, devi comprendere le azioni che lo guidano. Dato che i video provenienti da Internet non hanno etichette di azione, il LAM deve imparare a capire queste cose da solo.

IL modello dinamico è il cuore della potenza di creazione video di Google Genie. Prende i token video e le azioni calcolate dal LAM e li usa per prevedere come dovrebbe apparire il fotogramma successivo del video. È come avere una sfera di cristallo che può mostrarti il passo successivo di un film in base a ciò che è successo finora e all’azione che vuoi intraprendere.

VQ-VAE è una tecnica sofisticata che aiuta Google Genie a organizzare le informazioni. È un po’ come dare sia al tokenizzatore video che al LAM uno speciale codebook per tradurre le cose in pezzi più piccoli e più gestibili. Ciò rende l’apprendimento e la rappresentazione di modelli complessi nei video molto più efficienti.

Ecco un riepilogo del flusso di lavoro di Google Genie:

- Inferenza dell’azione latente:

- Codificatore: consente di acquisire una sequenza video. Genera rappresentazioni continue che si riferiscono alle azioni che si verificano tra i fotogrammi

- Decodificatore: Questo componente esiste solo per la formazione. Prevede il fotogramma successivo effettivo utilizzando i fotogrammi precedenti e le azioni latenti prodotte dal codificatore. Ciò aiuta ad addestrare il LAM a generare rappresentazioni di azioni significative

- VQ-VAE: Le azioni latenti previste vengono quantizzate in un piccolo insieme di codici discreti. Ciò garantisce un vocabolario d’azione limitato, facilitando il controllo umano durante il processo di generazione

- Tokenizzazione video:

- Tokenizzatore video basato su trasformatore ST (ST-ViViT): Incorpora informazioni sia spaziali che temporali durante la fase di tokenizzazione. Ciò migliora la qualità della generazione video rispetto ai tokenizzatori solo spaziali

- Modellazione dinamica:

- Trasformatore MaskGIT: Genie utilizza una variante solo decoder dell’architettura MaskGIT

- Ingresso: Ad ogni passo riceve sia i token video precedenti che la corrispondente azione latente

- Produzione: Prevede i token che rappresentano il fotogramma successivo

- Formazione: addestrato con una perdita di entropia incrociata per allineare i token previsti con i token reali del video. Il mascheramento viene utilizzato durante l’addestramento per migliorare la robustezza

- Inferenza:

- Inizializzazione: l’utente fornisce un frame immagine iniziale, che viene tokenizzato

- Selezione dell’azione: L’utente sceglie l’azione desiderata dal vocabolario discreto appreso durante la fase LAM

- Predizione: Il modello dinamico genera i token del frame successivo in base ai token del frame iniziale e all’azione scelta

- Decodifica: il decodificatore del tokenizzatore video riconverte i token previsti in un fotogramma video

- Autoregressione: Il processo si ripete, con il frame appena generato e una nuova azione specificata dall’utente che diventano l’input per la previsione successiva

Vuoi saperne di più? Qui è Il documento di ricerca di Google Genie.

Come utilizzare Google Genio

Mentre Google Genie non è ancora disponibile per l’uso pubblicopuoi trovare maggiori informazioni e demo affascinanti sul sito ufficiale. E tieni gli occhi aperti: questa tecnologia ha il potenziale per cambiare radicalmente il modo in cui creiamo e sperimentiamo i giochi!

Costruire il futuro dei giochi

Sebbene sia ancora nelle sue fasi iniziali, Google Genie mette in mostra la sorprendente potenza della creatività basata sull’intelligenza artificiale. Sfuma il confine tra i nostri mondi immaginati e quelli in cui giochiamo, suggerendo un futuro in cui condividere il tuo gioco sarà facile come condividere una foto.

Tuttavia, ci sono sfide da superare. Attualmente, Genie eccelle nei platform 2Dma il ridimensionamento verso mondi 3D complessi rimane difficile.

Inoltre, i giochi generati hanno controlli relativamente semplici; la ricerca futura si concentrerà probabilmente su un controllo più preciso e su una meccanica complessa.

Come modello generativo, Genie può essere sorprendente, nel bene e nel male, trovando modi per farlo guidare il processo di generazione verso l’intento del creatore è un’area di ricerca attiva.

Credito immagine in primo piano: Oleg Gamulinskii/Pixabay.