Google ha implementato un innovativo framework di intelligenza artificiale chiamato “Social Learning”, progettato per aumentare l’abilità collaborativa dei modelli linguistici salvaguardando al contempo la privacy degli utenti. Questo nuovo quadro consente ai modelli di intelligenza artificiale di impegnarsi in scambi di linguaggio naturale, condividendo intuizioni e migliorando la loro capacità collettiva su diversi compiti senza violare la privacy.

- Il concetto trae ispirazione dalla teoria dell’apprendimento sociale di Bandura e Walters del 1977enfatizzando l’apprendimento attraverso l’osservazione, sia tramite istruzioni verbali che imitando i comportamenti osservati.

- A differenza dei tradizionali metodi di apprendimento collaborativo che possono comportare la condivisione diretta dei dati, questo approccio consente ai LLM di insegnare e imparare gli uni dagli altri utilizzando il linguaggio naturaleaggirando le preoccupazioni sulla privacy.

- Il documento discute l’applicazione del framework in vari compiti, tra cui rilevamento dello spam, risoluzione dei problemi di matematica delle scuole elementari e risposta alle domande basata su testodimostrando la sua versatilità.

“I modelli linguistici di grandi dimensioni (LLM) hanno migliorato significativamente lo stato dell’arte per la risoluzione di compiti specificati utilizzando il linguaggio naturale, raggiungendo spesso prestazioni vicine a quelle delle persone. Poiché questi modelli abilitano sempre più gli agenti di assistenza, potrebbe essere utile per loro imparare efficacemente gli uni dagli altri, proprio come fanno le persone in contesti sociali, il che consentirebbe agli agenti basati su LLM di migliorare le reciproche prestazioni.

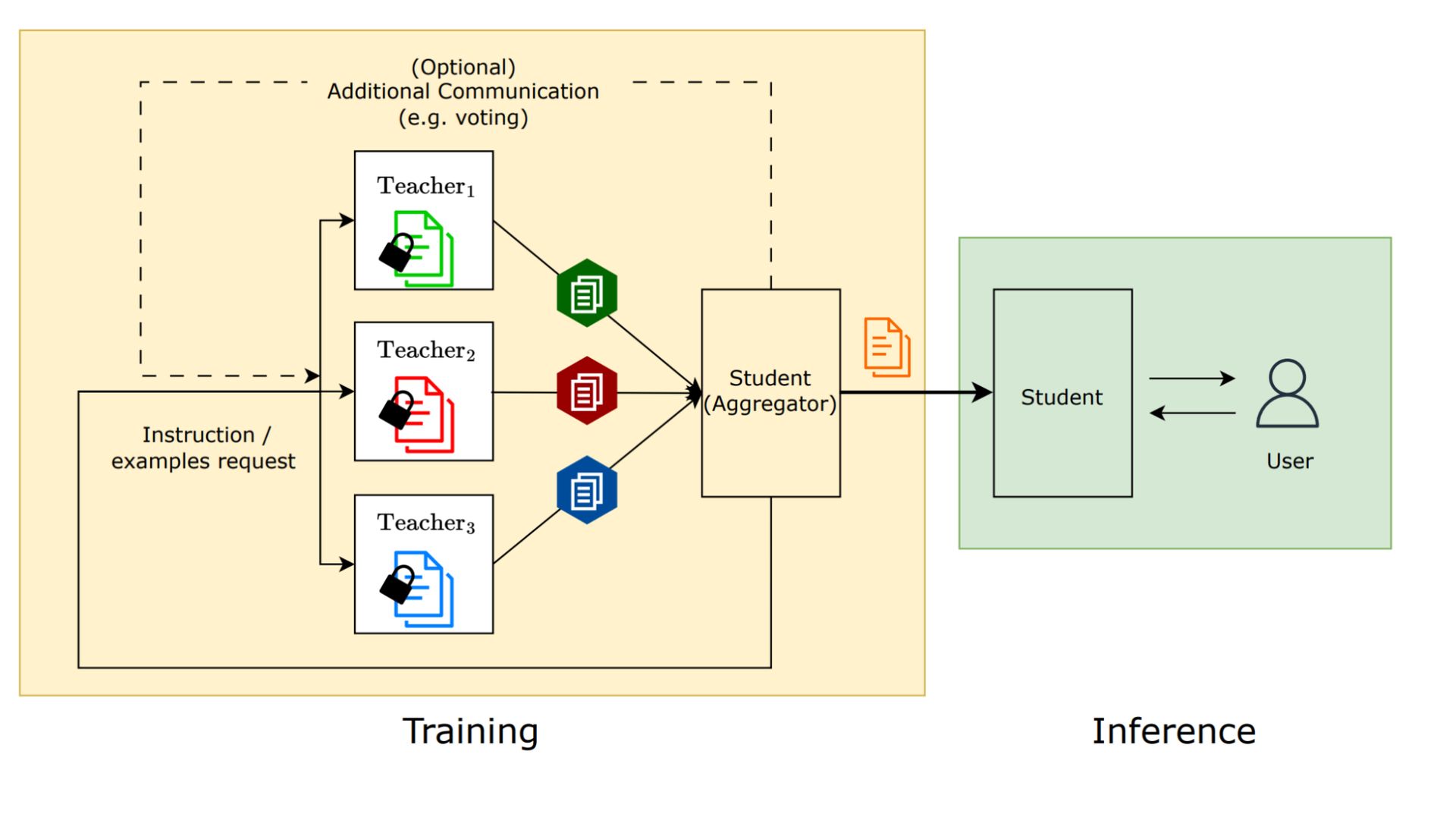

Come funziona il Social Learning di Google?

All’interno della configurazione del Social Learning, “insegnante“i modelli trasmettono la conoscenza a”alunno” senza la necessità di trasmettere informazioni sensibili o private, trovando un equilibrio tra apprendimento efficace e tutela della privacy. Questi modelli di studenti traggono lezioni da una varietà di modelli di insegnanti, ciascuno specializzato in compiti particolari come rilevare lo spam, risolvere enigmi matematici o fornire risposte basate su contenuto testuale.

Utilizzando esempi controllati da esseri umani, i modelli degli insegnanti possono educare i modelli degli studenti senza scambiare i dati originali, affrontando così le preoccupazioni sulla privacy legate alla condivisione dei dati. Inoltre, i modelli degli insegnanti hanno la capacità di creare nuovi scenari o creare istruzioni per compiti specifici, arricchendo il percorso educativo.

Le sperimentazioni di ricerca sottolineano il successo dell’apprendimento sociale nell’elevare le competenze dei modelli di studenti in una serie di compiti. Gli scenari sintetici elaborati dai modelli degli insegnanti si sono rivelati altrettanto efficaci quanto i dati autentici, il tutto riducendo drasticamente i rischi per la privacy. Allo stesso modo, le istruzioni sui compiti modellate dai modelli dell’insegnante sono state determinanti nel potenziare le prestazioni del modello dello studente, dimostrando la versatilità dei modelli linguistici nell’aderire alle direttive.

Per ancorare la protezione della privacy, la comunità di ricerca ha adottato misure come la metrica Secret Sharer per valutare l’entità dell’esposizione dei dati durante la fase di apprendimento. I risultati rivelano una trascurabile infiltrazione di dati sulla privacy, confermando la capacità del sistema di impartire istruzioni senza divulgare dettagli dal pool di dati originale.

Emulando il processo umano di apprendimento sociale, questi modelli lo sono abili nello scambio di know-how e nel miglioramento collettivo delle proprie capacità, il tutto dando priorità alla privacy degli utenti. Questa strategia apre nuove strade per la creazione di tecnologie IA attente alla privacy in vari campi. Guardando al futuro, i gruppi di ricerca sono pronti a perfezionare ulteriormente la struttura del Social Learning e ad approfondire la sua utilità in compiti e contesti di dati assortiti.

“Abbiamo introdotto un framework per l’apprendimento sociale che consente ai modelli linguistici con accesso a dati privati di trasferire conoscenza attraverso la comunicazione testuale mantenendo la privacy di tali dati. In questo quadro, abbiamo identificato la condivisione di esempi e la condivisione di istruzioni come modelli di base e li abbiamo valutati su molteplici attività. Inoltre, abbiamo adattato la metrica Secret Sharer al nostro framework, proponendo una metrica per misurare la perdita di dati”, ha affermato Google nella sua post sul blog.

“Come prossimi passi, stiamo cercando modi per migliorare il processo di insegnamento, ad esempio aggiungendo cicli di feedback e iterazioni. Inoltre, vogliamo studiare l’utilizzo dell’apprendimento sociale per modalità diverse dal testo”, si legge ulteriormente nel post sul blog.

Credito immagine in primo piano: Mitchell Luo/Unsplash