Università di Tsinghua E AI di Zhipu hanno introdotto in collaborazione CogVideoX, un modello testo-video open source pronto a sfidare i pesi massimi dell’intelligenza artificiale come Pista, Luma AIE Laboratori PikaDescritta in dettaglio in una recente pubblicazione su arXiv, questa innovazione offre agli sviluppatori di tutto il mondo funzionalità avanzate di generazione video.

CogVideoX: Nuovo strumento di intelligenza artificiale open source per la conversione di testo in video

“Presentiamo CogVideoX, modelli di trasformatori di diffusione su larga scala progettati per generare video basati su prompt di testo. Per modellare in modo efficiente i dati video, proponiamo di sfruttare un 3D Variational Autoencoder (VAE) per comprimere i video lungo dimensioni sia spaziali che temporali. Per migliorare l’allineamento testo-video, proponiamo un trasformatore esperto con l’esperto LayerNorm adattivo per facilitare la fusione profonda tra le due modalità. Utilizzando una tecnica di formazione progressiva, CogVideoX è abile nel produrre video coerenti e di lunga durata caratterizzati da movimenti significativi”, la carta legge.

Di recente hanno collaborato a OpenVoice, una piattaforma open source per la clonazione vocale sviluppata insieme al MIT e La mia Shelle ora hanno introdotto CogVideoX-5B, un modello text-to-video. Hanno anche stretto una partnership con Shengshu Technology per lanciare AI Viduuno strumento progettato per semplificare la creazione di video utilizzando l’intelligenza artificiale.

CogVideoX è in grado di creare video coerenti e di alta qualità, lunghi fino a sei secondi, a partire da semplici messaggi di testo.

Il modello di spicco, CogVideoX-5B, presenta 5 miliardi di parametri, producendo video con una risoluzione di 720×480 e 8 fotogrammi al secondo. Sebbene queste specifiche possano non rivaleggiare con gli ultimi sistemi proprietari, la vera svolta risiede nell’approccio open source di CogVideoX.

I modelli open source stanno rivoluzionando il settorerilasciando il loro codice e i pesi del modello al pubblico, il team Tsinghua ha effettivamente democratizzato una tecnologia che un tempo era dominio di giganti della tecnologia ben finanziati. Questa mossa dovrebbe accelerare i progressi nei video generati dall’intelligenza artificiale attingendo all’esperienza collettiva della comunità globale degli sviluppatori.

I ricercatori hanno ottenuto gli impressionanti risultati di CogVideoX attraverso diverse innovazioni chiave, tra cui un Autoencoder variazionale 3D per una compressione video efficiente e un “trasformatore esperto” progettato per migliorare l’allineamento testo-video.

“Per migliorare l’allineamento tra video e testi, proponiamo un Transformer esperto con LayerNorm adattivo esperto per facilitare la fusione tra le due modalità”, spiega il documento. Questa svolta consente un’interpretazione più precisa dei prompt di testo e una generazione video più accurata.

Come provare CogVideoX?

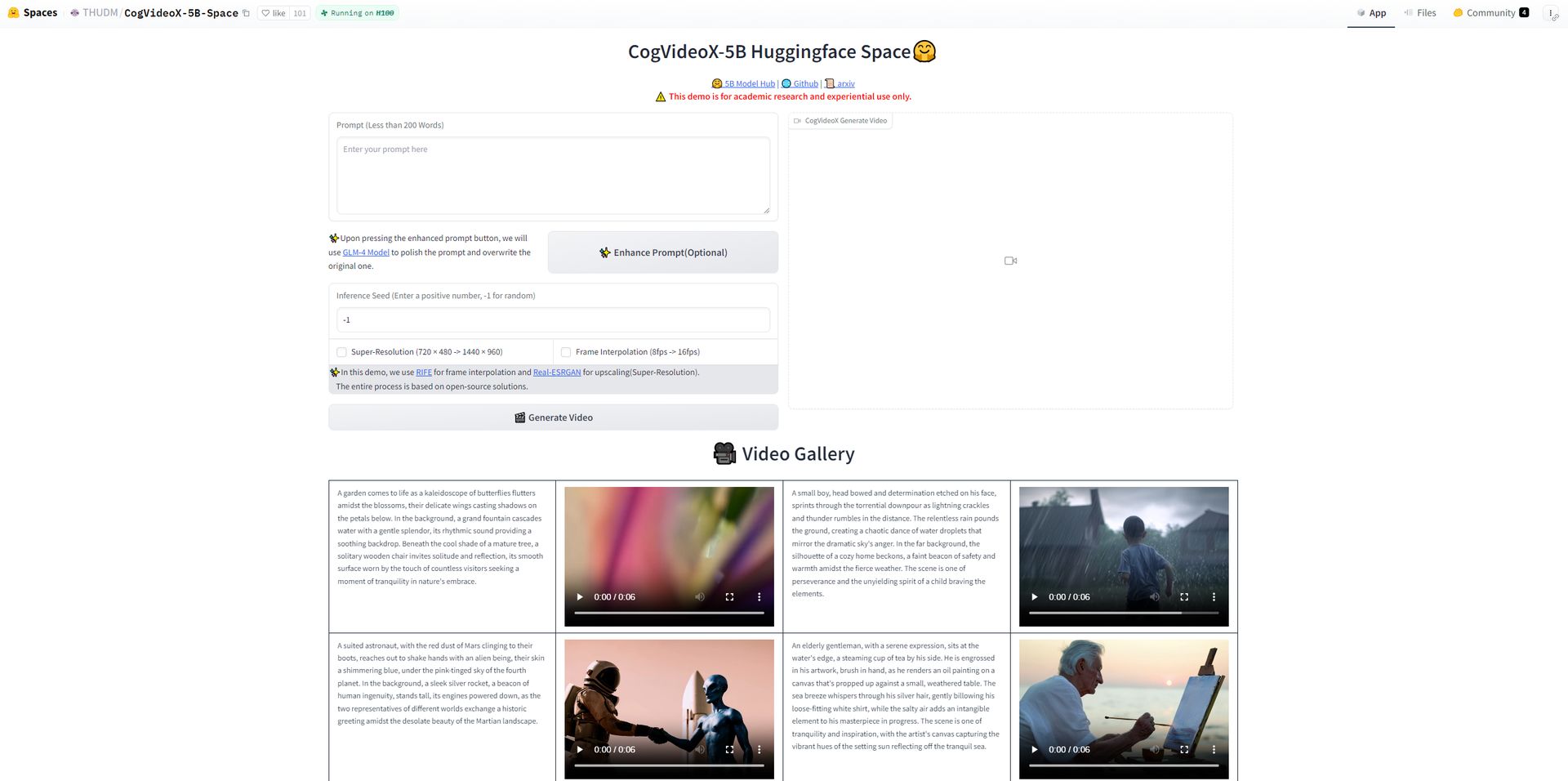

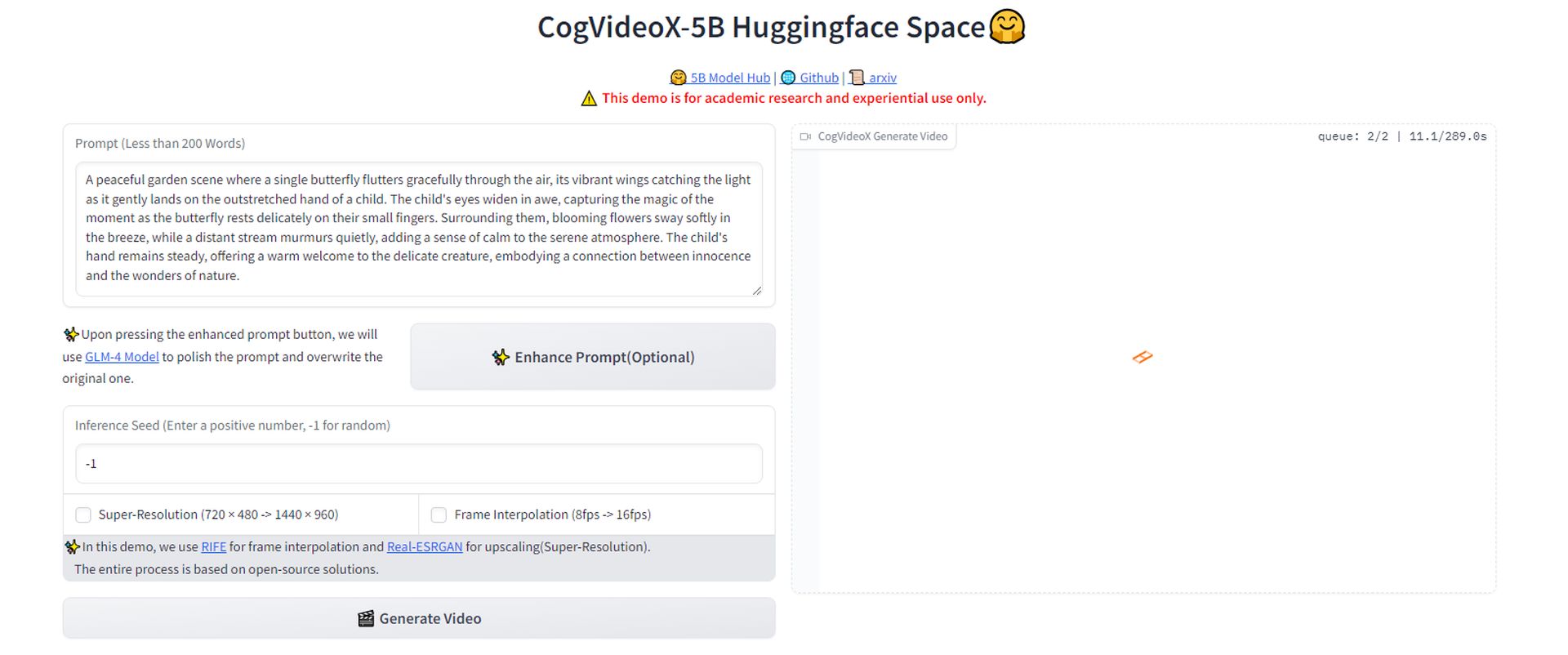

- Inizia andando sulla piattaforma HuggingFace dove il Strumento di generazione video open source CogVideoX-5B è disponibile per la prova.

- Crea un prompt descrittivo per il video che vuoi generare. Ad esempio, abbiamo usato:

- Una volta che il tuo prompt è pronto, clicca sul pulsante per generare il videoDovrai attendere qualche istante mentre lo strumento elabora la tua richiesta e crea il video in base alla tua descrizione.

- Dopo aver generato il video, potrai scaricarlo direttamente dalla piattaforma. Ciò ti consente di visualizzare il risultato del tuo prompt e di verificare con quale precisione lo strumento ha interpretato la tua descrizione.

- Guarda il video. Sebbene il risultato potrebbe non essere strabiliante, è importante notare che questi tipi di strumenti stanno rapidamente migliorando. Proprio come abbiamo visto con l’evoluzione di ChatGPT, è probabile che all’orizzonte si stia profilando una svolta significativa nei video generati dall’intelligenza artificiale.

L’ho provato, anche se non è ancora strabiliante, questi strumenti stanno spuntando ovunque. Mi aspetto una svolta a breve, proprio come abbiamo visto con ChatGPT. foto.twitter.com/53xYz6lBLf

— Kerem Gülen (@kgulenn) 28 agosto 2024

Vedremo sempre più deepfake

Tuttavia, l’ampia disponibilità di una tecnologia così potente non è priva di pericoli. Il potenziale di uso improprio, in particolare nella creazione di deepfake o contenuti fuorvianti, è un problema serio che la comunità dell’IA deve affrontare. Gli stessi ricercatori riconoscono queste preoccupazioni etiche, sollecitando un uso responsabile della tecnologia.

Man mano che i video generati dall’intelligenza artificiale diventano sempre più accessibili e avanzati, ci stiamo avventurando in territori sconosciuti nella creazione di contenuti digitali. Il lancio di CogVideoX potrebbe rappresentare un momento chiave, potenzialmente ridistribuendo il potere dai grandi attori del settore a un modello di sviluppo dell’intelligenza artificiale più aperto e decentralizzato.

I veri effetti di questa democratizzazione sono ancora incerti. Creerà una nuova ondata di creatività e innovazione, o peggiorerà i problemi esistenti di disinformazione e manipolazione digitale?

Credito immagine in evidenza: Kerem Gülen/Mezzo viaggio