In un mondo dominato da modelli di intelligenza artificiale che vivono nel cloud, Mistral AI sta ribaltando il copione. La startup francese appunto scatenato due nuovi modelli, Ministral 3B e 8B, progettati per funzionare su dispositivi edge.

Les Ministraux: Ministrale 3B e 8B

Le nuove offerte di Mistral, soprannominate “Les Ministraux”, potrebbero sembrare un film d’essai francese, ma questi modelli sono pronti a scuotere il mondo dell’intelligenza artificiale. Con appena 3 miliardi e 8 miliardi di parametri rispettivamente, la famiglia Ministraux è tutta una questione di efficienza. Dimentica quei modelli di intelligenza artificiale che consumano risorse e che richiedono un data center per funzionare.

“I nostri clienti e partner più innovativi richiedono sempre più un’inferenza locale, che metta al primo posto la privacy per le applicazioni critiche”, ha spiegato Mistral.

Lunghezza del contesto come mai prima d’ora

È qui che la questione diventa davvero piccante: sia il modello 3B che quello 8B possono gestire una finestra di contesto di 128.000 token. È l’equivalente di un libro di 50 pagine. Per fare un confronto, anche OpenAI GPT-4 Turbo si limita allo stesso numero di token, e non è un’impresa da poco.

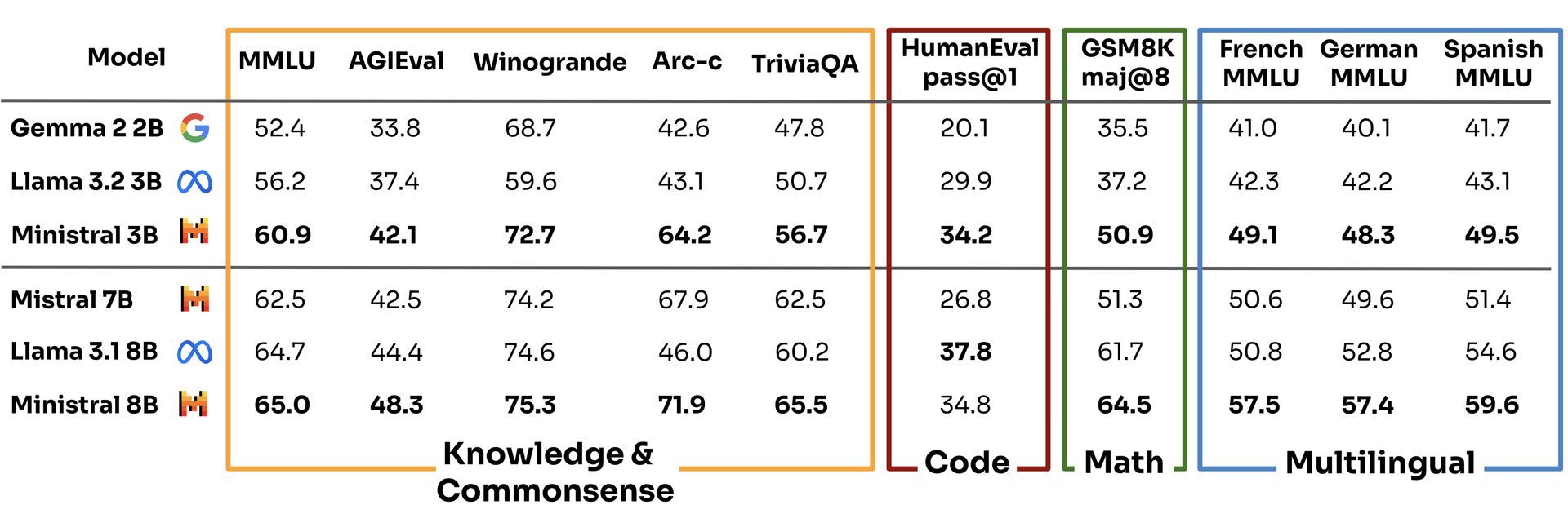

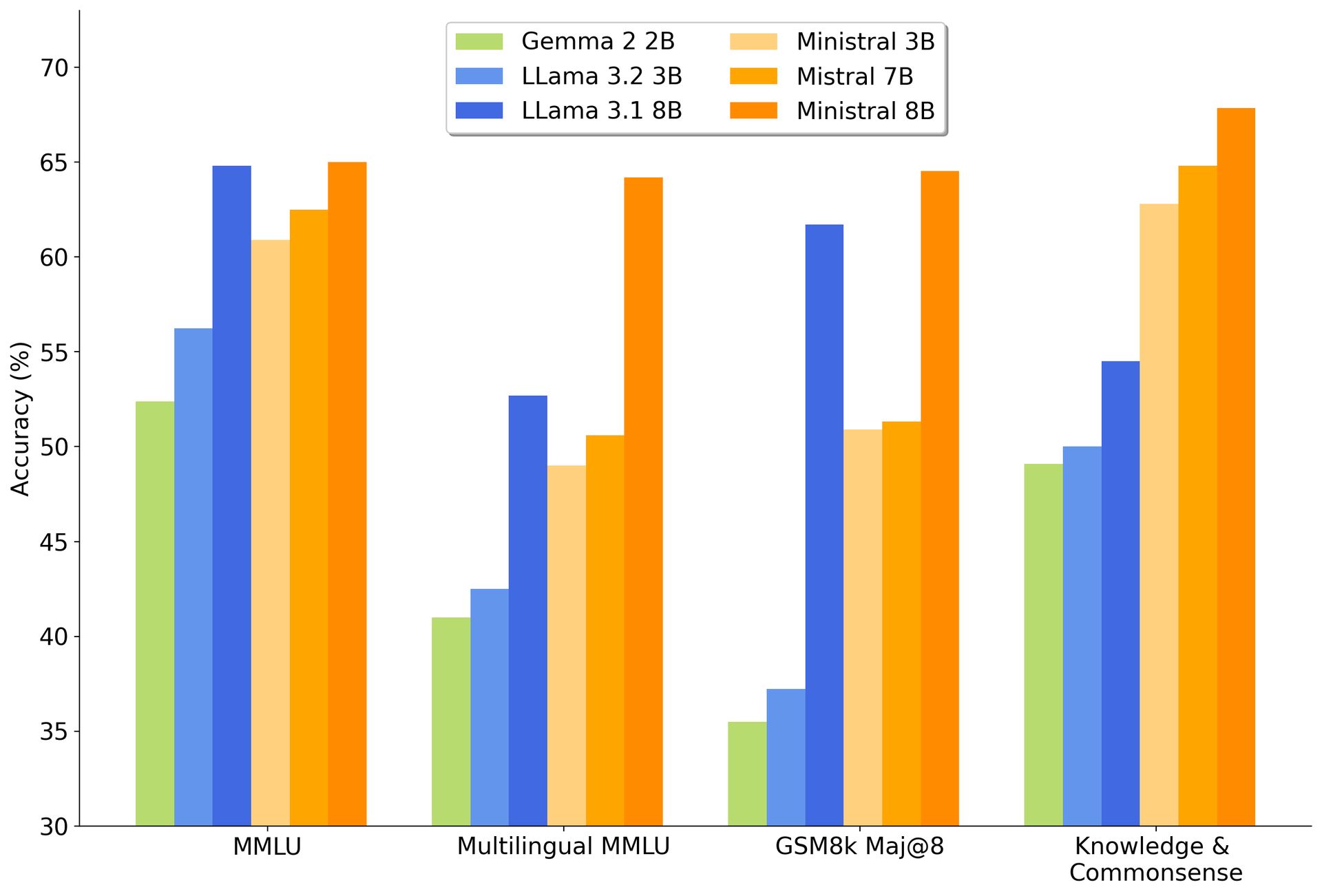

Con questo tipo di capacità, i modelli Ministraux non solo superano il loro predecessore, il Mistral 7B, ma divorano anche Google Gemma222B E I modelli di lama di Meta per colazione.

Secondo i benchmark di Mistral, il modello 3B ha ottenuto 60,9 nella valutazione Multi-task Language Understanding, lasciando concorrenti come Llama 3.2 3B e Gemma 2 2B rispettivamente a 56,2 e 52,4.

Non male per un modello “più piccolo”, vero?

Mentre tutti gli altri nel mondo dell’intelligenza artificiale si stanno affannando per creare modelli più grandi e più cattivi che divorano energia, Mistral sta giocando un gioco diverso. Funzionando su dispositivi locali, Les Ministraux elimina la necessità di enormi server cloud e, così facendo, offre un’opzione molto più ecologica. È una mossa che si allinea perfettamente con la crescente pressione sulle aziende tecnologiche affinché siano più attente all’ambiente. L’intelligenza artificiale potrebbe essere il futuro, ma nessuno vuole che quel futuro arrivi a scapito del pianeta.

C’è anche l’angolo della privacy. Poiché tutto funziona localmente, i tuoi dati rimangono sul tuo dispositivo, il che rappresenta un enorme vantaggio per settori come quello sanitario e finanziario, che sono sempre più sotto esame per il modo in cui gestiscono le informazioni sensibili. Puoi considerarla come un’intelligenza artificiale senza ficcanaso: un cambiamento rinfrescante in un mondo in cui ogni app sembra raccogliere più dati della NSA.

Il piano generale di Mistral: costruire, distruggere, ripetere

Ma non illudiamoci: Mistral non lo fa solo per il bene comune. L’azienda, co-fondata da ex studenti di Meta e DeepMind di Google, si occupa di creare scalpore. Hanno già raccolto 640 milioni di dollari in capitale di rischio e sono concentrati sulla costruzione di modelli di intelligenza artificiale che non solo competono con quelli del calibro di GPT-4 di OpenAI e Claude di Anthropic, ma generano anche un profitto nel processo.

E anche se guadagnare nello spazio dell’intelligenza artificiale generativa è facile quanto vincere alla lotteria, Mistral non si tira indietro. In effetti, hanno iniziato a generare entrate la scorsa estate, il che è più di quanto si possa dire per molti dei loro concorrenti.

Offrendo Ministral 8B per scopi di ricerca e rendendo disponibili entrambi i modelli attraverso la loro piattaforma cloud, La Platforme, Mistral si sta posizionando come il ragazzo cool nel blocco dell’intelligenza artificiale: abbastanza aperto da attrarre sviluppatori, ma abbastanza intelligente da monetizzare la sua tecnologia attraverso partnership strategiche. È un approccio ibrido che rispecchia ciò che i giganti dell’open source come Red Hat hanno fatto nel mondo Linux, promuovendo la comunità e mantenendo i registratori di cassa in funzione.

Crediti immagine: Maestrale