In quello che molti chiamano “l’anno dell’intelligenza artificiale incarnata”, Meta lo ha fatto fatto un grande passo nel far progredire le capacità robotiche attraverso una serie di nuove tecnologie. La divisione Fundamental AI Research (FAIR) di Meta ha recentemente introdotto tre artefatti di ricerca: Meta Sparsh, Meta Digit 360 e Meta Digit Plexus, ciascuno dei quali apporta progressi nella percezione tattile, nella destrezza e nella collaborazione uomo-robot.

Cos’è l’intelligenza artificiale incorporata e perché è importante?

L’intelligenza artificiale incarnata si riferisce a sistemi di intelligenza artificiale progettati per esistere e operare all’interno del mondo fisico, comprendendo e interagendo con l’ambiente circostante in modi che imitano la percezione e le azioni umane. I sistemi di intelligenza artificiale tradizionali eccellono nell’analisi dei dati ma non sono all’altezza quando applicati a compiti fisici, che richiedono non solo la vista ma anche feedback sensoriali come il tatto. Costruendo un’intelligenza artificiale incorporata, i ricercatori mirano a creare robot in grado di percepire, rispondere e persino adattarsi al loro ambiente, colmando il divario tra intelligenza digitale e funzionalità del mondo reale.

Le innovazioni di Meta nell’intelligenza artificiale incarnata mirano a raggiungere ciò che il suo capo scienziato dell’intelligenza artificiale Yann LeCun chiama Advanced Machine Intelligence (AMI). Questo concetto prevede macchine in grado di ragionare su causa ed effetto, pianificare azioni e adattarsi ai cambiamenti nel loro ambiente, passando così da semplici strumenti ad assistenti collaborativi.

Le scoperte di Meta nell’intelligenza artificiale incorporata: Sparsh, Digit 360 e Digit Plexus

I recenti annunci di Meta sottolineano il suo impegno nell’affrontare i limiti dell’attuale tecnologia robotica. Esploriamo le funzionalità di ogni nuovo strumento.

Meta Sparsh: il fondamento del rilevamento tattile

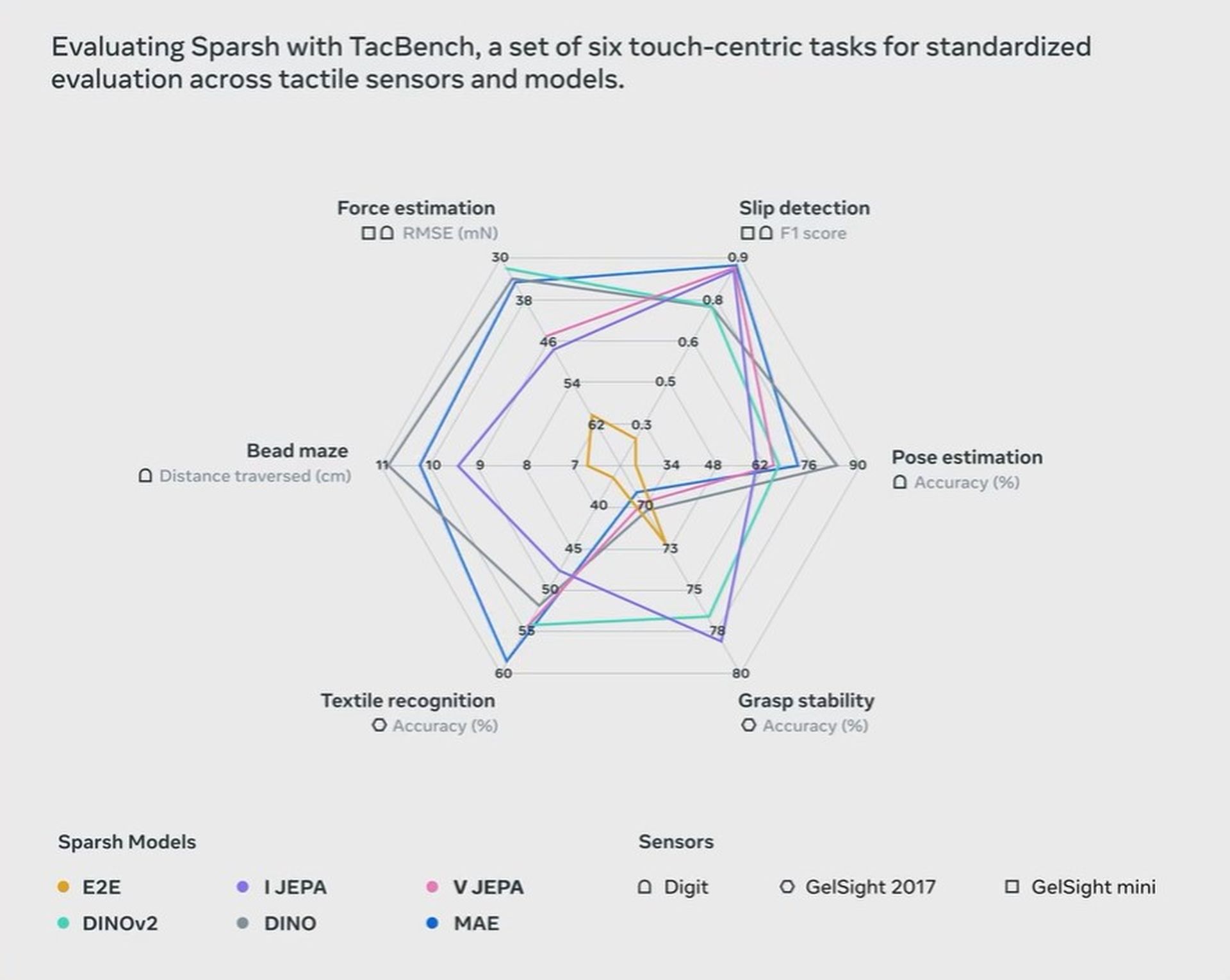

Meta Sparsh, che significa “tocco” in sanscrito, è un modello di rilevamento tattile basato sulla visione, primo nel suo genere, che consente ai robot di “sentire” superfici e oggetti. Sparsh è un codificatore generico che si basa su un database di oltre 460.000 immagini tattili per insegnare ai robot a riconoscere e interpretare il tocco. A differenza dei modelli tradizionali che richiedono una formazione specifica per attività, Sparsh sfrutta l’apprendimento autosupervisionato, consentendogli di adattarsi a vari compiti e sensori senza bisogno di dati etichettati estesi.

Questa capacità di generalizzare è fondamentale per i robot che devono eseguire un’ampia gamma di compiti. Sparsh funziona con diversi sensori tattili, integrandosi perfettamente in diverse configurazioni robotiche. Consentendo ai robot di percepire il tatto, Sparsh apre opportunità in aree in cui la manipolazione abile e il feedback tattile sono fondamentali, come nelle applicazioni mediche, nella chirurgia robotica e nella produzione di precisione.

Meta Digit 360: rilevamento tattile a livello umano nella robotica

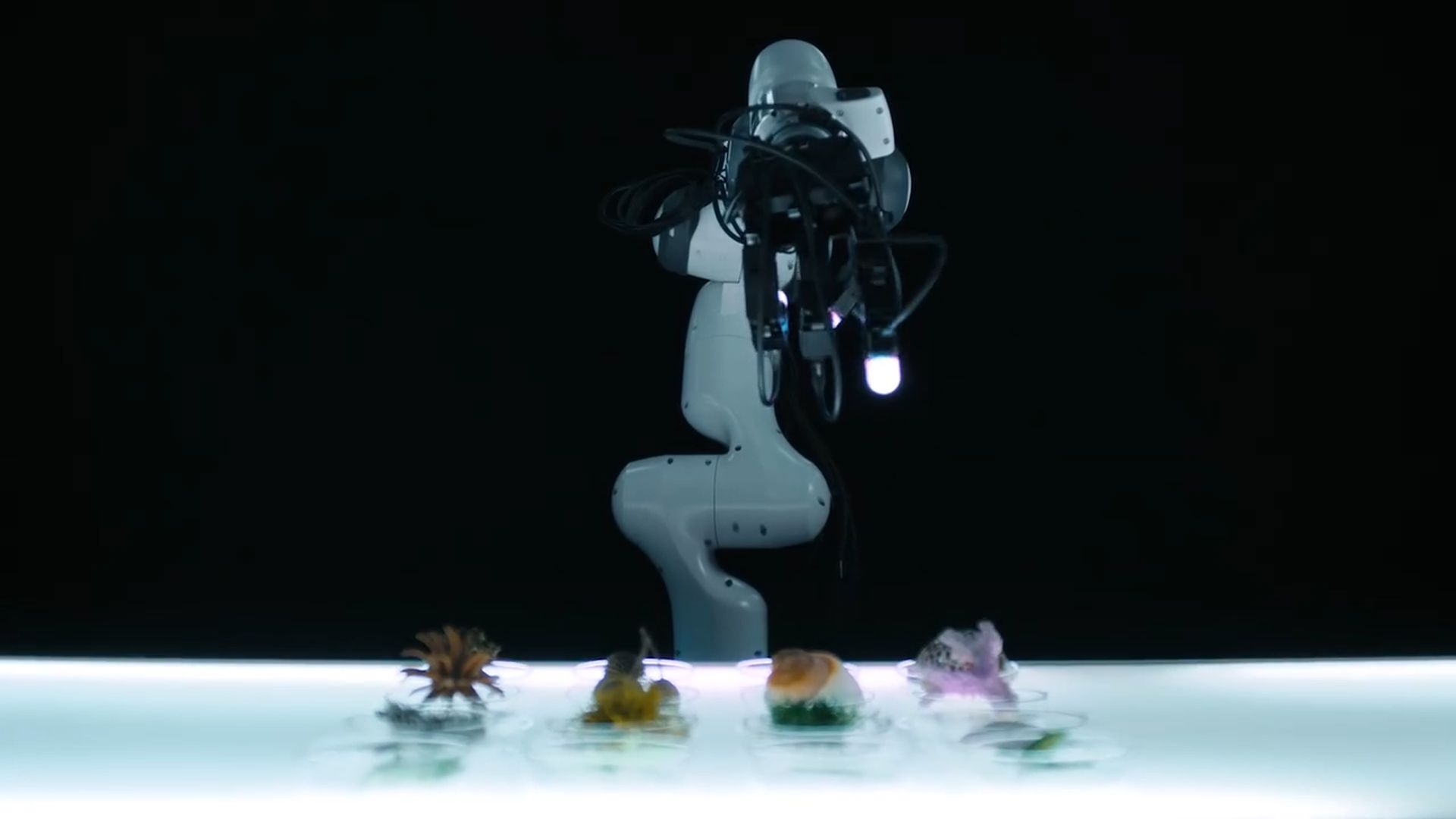

Digit 360 è il nuovo sensore tattile per dita di Meta progettato per replicare il tocco umano. Dotato di 18 funzioni di rilevamento distinte, Digit 360 fornisce dati tattili altamente dettagliati in grado di catturare piccoli cambiamenti nella superficie, nella forza e nella struttura di un oggetto. Costruito con oltre 8 milioni di “taxel” (pixel tattili), Digit 360 consente ai robot di rilevare forze sottili fino a 1 millinewton, migliorando la loro capacità di eseguire compiti complessi e sfumati.

Questa svolta nel rilevamento tattile ha applicazioni pratiche in vari campi. Nel settore sanitario, Digit 360 potrebbe essere utilizzato nelle protesi per offrire ai pazienti un senso del tatto accentuato. Nella realtà virtuale, potrebbe migliorare le esperienze immersive consentendo agli utenti di “sentire” gli oggetti in ambienti digitali. Meta sta collaborando con GelSight Inc per commercializzare Digit 360, con l’obiettivo di renderlo accessibile alla più ampia comunità di ricerca entro il prossimo anno.

Meta Digit Plexus: una piattaforma per mani robotiche abilitate al tocco

La terza versione principale di Meta, Digit Plexus, è una piattaforma hardware-software standardizzata progettata per integrare vari sensori tattili in un’unica mano robotica. Digit Plexus combina sensori della punta delle dita e del palmo, offrendo ai robot un sistema di risposta al tocco più coordinato e simile a quello umano. Questa integrazione consente ai robot di elaborare il feedback sensoriale e apportare modifiche in tempo reale durante le attività, in modo simile a come operano le mani umane.

Standardizzando il feedback tattile sulla mano robotica, Digit Plexus migliora il controllo e la precisione. Meta prevede applicazioni per questa piattaforma in settori quali la produzione e la manutenzione remota, dove la gestione delicata dei materiali è essenziale. Per aiutare a costruire una comunità di robotica open source, Meta sta rendendo disponibili gratuitamente i progetti software e hardware per Digit Plexus.

Le partnership di Meta con GelSight Inc e Wonik Robotics

Oltre a questi progressi tecnologici, Meta ha stretto partnership per accelerare l’adozione del rilevamento tattile nella robotica. Collaborando con GelSight Inc e Wonik Robotics, Meta mira a portare le sue innovazioni a ricercatori e sviluppatori di tutto il mondo. GelSight Inc gestirà la distribuzione di Digit 360, mentre Wonik Robotics produrrà Allegro Hand, una mano robotica integrata con Digit Plexus, il cui lancio è previsto per il prossimo anno.

Queste partnership sono significative in quanto rappresentano un passaggio verso la democratizzazione della tecnologia robotica. Rendendo questi sistemi tattili avanzati ampiamente disponibili, Meta sta promuovendo un ecosistema collaborativo che potrebbe produrre nuove applicazioni e migliorare le prestazioni dei robot in tutti i settori.

PARTNR: un nuovo punto di riferimento per la collaborazione uomo-robot

Meta sta inoltre introducendo PARTNR (Planning And Reasoning Tasks in humaN-Robot Collaboration), un benchmark progettato per valutare modelli di intelligenza artificiale sulle interazioni uomo-robot in ambienti domestici. Costruito sul simulatore Habitat 3.0, PARTNR fornisce un ambiente realistico in cui i robot possono interagire con gli esseri umani attraverso compiti complessi, che vanno dalle faccende domestiche alla navigazione nel mondo fisico.

Con oltre 100.000 attività basate sulla lingua, PARTNR offre un modo standardizzato per testare l’efficacia dei sistemi di intelligenza artificiale in scenari collaborativi. Questo benchmark mira a guidare la ricerca sui robot che agiscono come “partner” piuttosto che semplici strumenti, dotandoli della capacità di prendere decisioni, anticipare i bisogni umani e fornire assistenza nelle impostazioni quotidiane.

Crediti immagine: Meta