Gli avatar AI, o “teste parlanti”, hanno segnato un nuovo passo nel modo in cui affrontiamo e comprendiamo il coinvolgimento digitale. Non molto tempo fa, trasformando una singola foto e un clip audio in un file somiglianza realistica e parlante sembrava impossibile: il massimo che siamo riusciti a ottenere è stato un risultato ‘uncanny Valley’, sicuramente inadatto a qualsiasi uso esterno.

Ora la situazione è molto diversa. Fondamentale per strumenti come Synthesia, questo processo di creazione di avatar IA inizia con la creazione da parte dell’IA di una “identità digitale” da un’immagine, quindi l’animazione per sincronizzare i movimenti facciali con l’audio, in modo che l’avatar “parli” per l’utente durante una presentazione, un reel, o evento. Questo progresso lo deve a metodi all’avanguardia come GANnoto per l’output visivo rapido e di alta qualità e per i modelli di diffusione, apprezzati per la loro ricchezza di dettagli, sebbene più lenti. Synthesia, D-ID e Hume AI sono tra le aziende che promuovono questi strumenti e assumono l’iniziativa di rendere questa tecnologia quanto più adatta possibile alle esigenze attuali.

Tuttavia, il vero realismo è ancora fuori portata. Le reti neurali elaborano i dettagli visivi in modo diverso dagli esseri umani, spesso trascurando segnali sottili, come il preciso allineamento dei denti e dei peli del viso, che modellano il modo in cui le persone percepiscono naturalmente i volti. Ne parleremo più avanti.

Questo articolo parla del funzionamento interno della tecnologia e delle sfide che gli sviluppatori devono affrontare quando cercano di far sì che gli avatar IA assomiglino ai nostri volti familiari. Quanto realistici possono diventare?

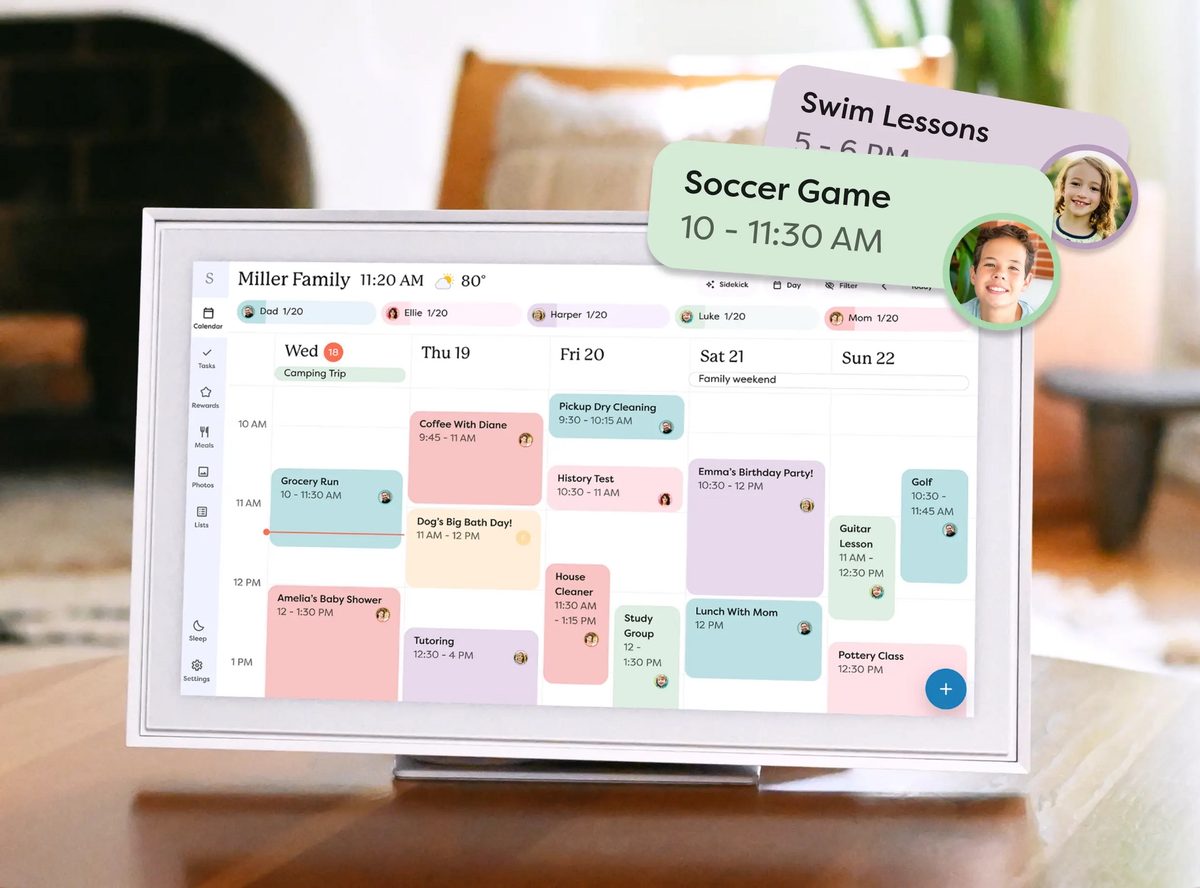

Come funziona il processo di generazione dell’avatar AI

![]()

La creazione di un avatar AI inizia con il caricamento di una foto o di un video da parte dell’utente. Questo input viene elaborato tramite un “Estrattore di identità”, una rete neurale addestrata per identificare e codificare l’aspetto fisico di una persona. Questo modello estrae le caratteristiche principali del viso e le converte in una “identità digitale”, che può essere utilizzata per animare realisticamente l’avatar. Da questa rappresentazione, gli sviluppatori possono controllare i movimenti attraverso un segnale “driver”, in genere audio o video aggiuntivo, che determina come l’avatar dovrebbe muoversi e parlare.

Il segnale del conducente è vitale nel processo di animazione. Determina sia la sincronizzazione labiale con l’audio che le espressioni facciali più ampie. Ad esempio, in un avatar parlante, i segnali audio influenzano la forma e il movimento della bocca per adattarsi al parlato. A volte, i punti chiave del viso (ad esempio gli angoli degli occhi e della bocca) vengono utilizzati per guidare con precisione il movimento, mentre in altri casi la posa dell’intero avatar viene modificata per corrispondere al segnale del conducente. Per garantire che l’espressione sia naturale, la rete neurale può utilizzare tecniche come il “warping”, che rimodella dolcemente le caratteristiche dell’avatar in base ai segnali di input di cui sopra.

Come ultimo passaggio, un processo di decodifica traduce questa identità digitale modificata in una forma visiva generando singoli fotogrammi e assemblandoli in un video senza soluzione di continuità. Le reti neurali in genere non funzionano in modo reversibile, quindi la decodifica richiede una formazione separata per convertire accuratamente la rappresentazione digitale animata in immagini continue e realistiche. Il risultato è un avatar che rispecchia fedelmente le espressioni e i movimenti umani, ma rimane comunque vincolato dai limiti dell’attuale capacità dell’intelligenza artificiale di percepire i dettagli facciali.

GAN, modelli di diffusione e metodi basati sul 3D: i tre pilastri della generazione di avatar

Le tecnologie fondamentali che consentono questa trasformazione avanzano continuamente per catturare in modo più accurato le espressioni umane, sviluppando passo dopo passo il processo di generazione degli avatar. Tre approcci principali stanno guidando il progresso in questo momento, e ognuno di essi presenta vantaggi e limiti particolari:

Il primo, GAN (Generative Adversarial Networks), utilizza due reti neurali in tandem – un generatore e un discriminatore – per creare immagini altamente realistiche. Questo approccio consente una generazione di immagini rapida e di alta qualità, rendendolo adatto per applicazioni in tempo reale con una chiara esigenza di avatar fluidi e reattivi. Tuttavia, anche se i GAN eccellono in termini di velocità e qualità visiva, possono essere difficili da controllare con precisione. Ciò può limitarne l’efficacia nei casi che richiedono una personalizzazione dettagliata.

Modelli di diffusione sono un altro potente strumento. Trasformano gradualmente il rumore in un’immagine di alta qualità attraverso passaggi ripetuti. Noti per la generazione di immagini dettagliate e altamente controllabili, i modelli di diffusione sono più lenti e richiedono una notevole potenza di calcolo. Quindi sono ideali per il rendering offline e l’uso in tempo reale – non tanto. La forza di questo modello sta nella produzione di dettagli sfumati e fotorealistici, anche se a un ritmo più lento.

Finalmente, Metodi basati su 3D come Neural Radiance Fields (NeRF) e Gaussian Splatting costruiscono una rappresentazione visiva mappando le informazioni spaziali e cromatiche in una scena 3D. Questi metodi differiscono leggermente, poiché lo Splatting è più veloce e i NeRF funzionano a un ritmo più lento. Gli approcci basati sul 3D sono più adatti per i giochi o gli ambienti interattivi. Tuttavia, NeRF e Gaussian Splatting possono non essere all’altezza del realismo visivo, producendo attualmente un aspetto che può apparire artificiale in scenari che richiedono sembianze umane.

Ciascuna tecnologia presenta un equilibrio tra velocità, qualità e controllo più adatto alle diverse applicazioni. I GAN sono ampiamente utilizzati per applicazioni in tempo reale grazie alla loro combinazione di velocità e qualità visiva, mentre i modelli di diffusione sono preferiti in contesti “offline”, dove il rendering non avviene in tempo reale, consentendo un calcolo più intenso per ottenere dettagli più fini. I metodi 3D continuano ad evolversi per esigenze di alte prestazioni, ma attualmente mancano della precisione visiva realistica richiesta per rappresentazioni simili a quelle umane.

Queste tecnologie riassumono abbastanza bene gli attuali sviluppi e le sfide nel settore. La ricerca continua mira a unire le loro forze per ottenere risultati più realistici, ma per ora è di questo che ci occupiamo.

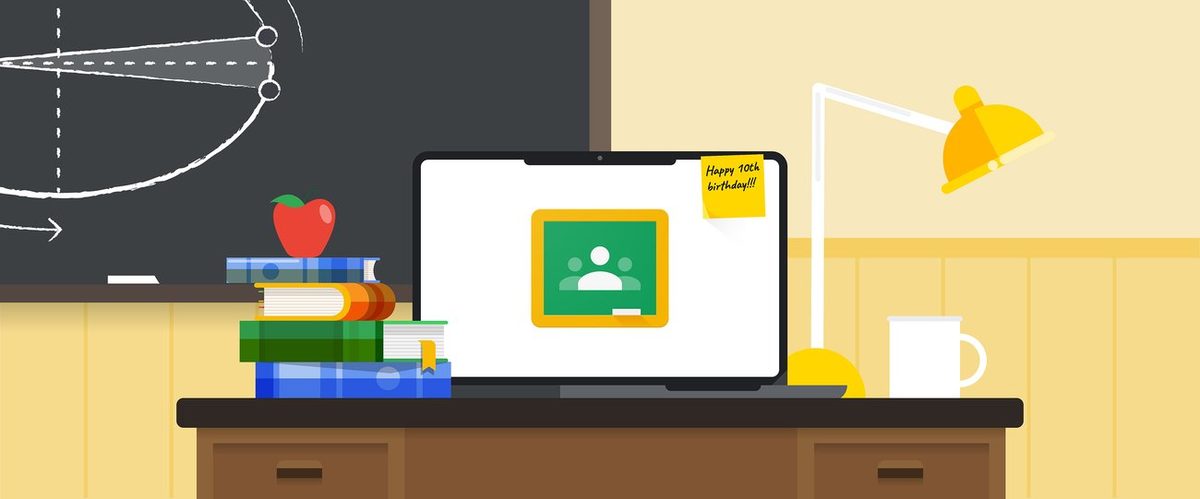

La sfida “Denti e barbe” dell’avatar AI

![]()

La creazione di avatar IA realistici inizia con la raccolta di dati di addestramento di alta qualità – un compito complesso di per sé – ma un aspetto meno ovvio e altrettanto impegnativo è l’acquisizione di piccoli dettagli che definiscono l’essere umano come denti E barbe. Questi elementi sono notoriamente difficili da modellare accuratamente, in parte a causa dei limitati dati di addestramento disponibili. Ad esempio, le immagini dettagliate dei denti, in particolare dei denti inferiori, sono scarse nei set di dati tipici: sono spesso nascoste nel linguaggio naturale. I modelli faticano a ricostruire strutture dentali realistiche senza esempi sufficienti, il che spesso porta ad aspetti distorti o innaturali, come “sgretolamenti” o posizionamenti strani.

Le barbe aggiungono un livello simile di complessità. Posizionate vicino alla bocca, le barbe si spostano con i movimenti del viso e cambiano sotto diverse luci, rendendo immediatamente evidente ogni difetto. Se non modellata con precisione, la barba può apparire statica, sfocata o strutturata in modo innaturale, il che sminuisce il realismo complessivo dell’avatar.

L’altro fattore che complica questi dettagli è la percezione della rete neurale. Gli esseri umani si concentrano intuitivamente sulle sfumature del viso come i denti e i peli del viso per identificare gli individui, mentre i modelli neurali diffondono l’attenzione su tutto il viso, spesso ignorando questi elementi più piccoli ma chiave. Per il modello, denti e barbe sono meno significativi; per gli esseri umani, sono indicatori di identità essenziali. Questo può essere superato solo attraverso un’ampia messa a punto e riqualificazione, che spesso richiede lo stesso sforzo del perfezionamento della struttura facciale complessiva.

Ora possiamo vedere a limitazione fondamentale: sebbene questi modelli avanzino verso il realismo, restano appena lontani dal catturare la sottigliezza della percezione umana.

I recenti progressi nella tecnologia degli avatar IA hanno portato le espressioni dall’aspetto naturale più vicine alla realtà che mai. GAN, modelli di diffusione e approcci 3D emergenti hanno completamente perfezionato la generazione di “teste parlanti” e ogni approccio offre una prospettiva e un kit di strumenti unici per trasformare un’idea, un tempo futuristica, in realtà.

I GAN offrono la velocità necessaria per le applicazioni in tempo reale; i modelli di diffusione contribuiscono al controllo sfumato, sebbene più lento. Tecniche come Splatting gaussiano in 3D apportano efficienza, a volte a scapito della fedeltà visiva.

Nonostante questi miglioramenti, la tecnologia ha ancora molta strada da fare per quanto riguarda il realismo. Non importa quanto sia messo a punto il tuo modello, di tanto in tanto, molto probabilmente incontrerai una dentatura un po’ inquietante o una disposizione sgradevole dei peli del viso. Ma, man mano che i dati disponibili di alta qualità crescono nel tempo, le reti neurali svilupperanno la capacità di mostrare coerenza nel modo in cui rappresentano i micro-tratti umani innati. Ciò che è parte integrante della nostra percezione è solo un parametro per i modelli di intelligenza artificiale.

Questo divario evidenzia una lotta in corso: i risultati tecnologici ci fanno avanzare, ma l’obiettivo di creare avatar autenticamente realistici rimane sfuggente, proprio come il paradosso di Achille e la tartaruga: non importa quanto ci avviciniamo, la perfezione rimane fuori portata.