Generazione di testo in video non è più quello che era nemmeno pochi anni fa. Lo abbiamo trasformato in uno strumento dalle funzionalità davvero futuristiche. Gli utenti creano contenuti per le pagine personali, gli influencer li sfruttano per l’autopromozione e le aziende li utilizzano per qualsiasi cosa, dalla pubblicità e dai materiali didattici alla formazione virtuale e alla produzione cinematografica. La maggior parte dei sistemi text-to-video sono costruiti sull’architettura dei trasformatori di diffusione, che sono l’avanguardia nel mondo della generazione video. Questa tecnologia funge da base per servizi come Luma e Kling. Tuttavia, questo status si è consolidato solo nel 2024, quando i primi trasformatori di diffusione per video hanno ottenuto l’adozione sul mercato.

La svolta è arrivata Rilascio di OpenAI Di SORAmostrando scatti incredibilmente realistici che erano quasi indistinguibili dalla vita reale. OpenAI ha dimostrato che il suo trasformatore di diffusione poteva generare con successo contenuti video. Questa mossa ha convalidato il potenziale della tecnologia e ha innescato una tendenza in tutto il settore: ora circa il 90% dei modelli attuali si basa su trasformatori di diffusione.

La diffusione è un processo affascinante che merita un’esplorazione più approfondita. Comprendiamo come funziona la diffusione, le sfide che la tecnologia del trasformatore affronta in questo processo e perché svolge un ruolo così significativo nella generazione di testo in video.

In cosa consiste il processo di diffusione GenAI?

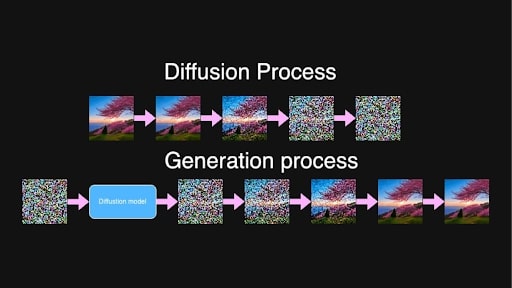

Al centro della generazione da testo a video e da testo a immagine si trova il processo di diffusione. Ispirati al fenomeno fisico in cui le sostanze si mescolano gradualmente, come l’inchiostro che si diffonde nell’acqua, i modelli di diffusione nell’apprendimento automatico prevedono un processo in due fasi: aggiungere rumore ai dati e quindi imparare a rimuoverlo.

Durante l’addestramento, il modello acquisisce immagini o sequenze di fotogrammi video e aggiunge progressivamente rumore in più passaggi fino a quando il contenuto originale diventa indistinguibile. Essenzialmente, lo trasforma in puro rumore.

Prompt dei processi di diffusione e generazione per “Bellissimo albero di sakura che soffia posto sulla collina durante l’alba”.

Prompt dei processi di diffusione e generazione per “Bellissimo albero di sakura che soffia posto sulla collina durante l’alba”.

Quando si generano nuovi contenuti, il processo funziona al contrario. Il modello è addestrato per prevedere e rimuovere il rumore in incrementi, concentrandosi su un passaggio di rumore intermedio casuale tra due punti, t e t+1. Grazie al lungo processo di addestramento, il modello ha osservato tutti i passaggi nella progressione dal rumore puro alle immagini quasi pulite e ora ha la capacità di identificare e ridurre il rumore praticamente a qualsiasi livello.

Dal rumore puro e casuale, il modello, guidato dal testo di input, crea in modo iterativo fotogrammi video coerenti e corrispondenti alla descrizione testuale. Contenuti video dettagliati e di alta qualità sono il risultato di questo processo molto graduale.

La diffusione latente è ciò che lo rende computazionalmente possibile. Invece di lavorare direttamente con immagini o video ad alta risoluzione, i dati vengono compressi in uno spazio latente da un codificatore.

Questo viene fatto per ridurre (significativamente) la quantità di dati che il modello deve elaborare, accelerando la generazione senza compromettere la qualità. Dopo che il processo di diffusione ha affinato le rappresentazioni latenti, un decodificatore le trasforma nuovamente in immagini o video a piena risoluzione.

Il problema con la generazione di video

A differenza di una singola immagine, il video richiede che oggetti e personaggi rimangano stabili ovunque, impedendo spostamenti o cambiamenti di aspetto imprevisti. Abbiamo tutti visto le meraviglie di cui è capace l’intelligenza artificiale generativa, ma l’occasionale braccio mancante o l’espressione facciale indistinguibile rientrano nella norma. Nel video, però, la posta in gioco è più alta; la consistenza è fondamentale per una sensazione fluida.

Quindi, se un personaggio appare nel primo fotogramma indossando un abito specifico, quell’abito deve apparire identico in ogni fotogramma successivo. Qualsiasi cambiamento nell’aspetto del personaggio, o qualsiasi “trasformazione” degli oggetti sullo sfondo, interrompe la continuità e rende il video innaturale o addirittura inquietante.

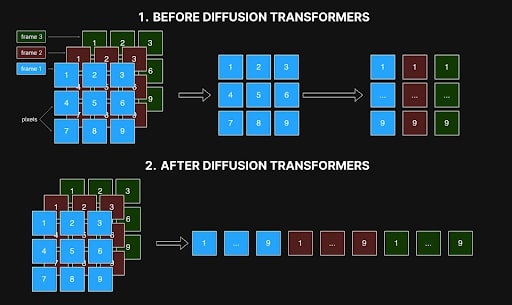

Immagine fornita dall’autore

I primi metodi si avvicinavano alla generazione video elaborando i fotogrammi individualmente, con ciascun pixel in un fotogramma che faceva riferimento solo al pixel corrispondente negli altri. Tuttavia, questo approccio fotogramma per fotogramma spesso dava luogo a incoerenze, poiché non riusciva a catturare le relazioni spaziali e temporali tra i fotogrammi che sono essenziali per transizioni fluide e movimenti realistici. Artefatti come colori mutevoli, forme fluttuanti o caratteristiche disallineate sono il risultato di questa mancanza di coerenza e riducono la qualità complessiva del video.

Immagine fornita dall’autore

Immagine fornita dall’autore

Il più grande ostacolo nella risoluzione di questo problema è stata la domanda computazionale e il costo. Per un video di 10 secondi a 10 fotogrammi al secondo, la generazione di 100 fotogrammi aumenta esponenzialmente la complessità. Creare questi 100 fotogrammi è circa 10.000 volte più complesso che generare un singolo fotogramma a causa della necessità di una precisa coerenza fotogramma per fotogramma. Questo compito richiede 10.000 volte di più in termini di memoria, tempo di elaborazione e risorse computazionali, spesso superando i limiti pratici. Come puoi immaginare, il lusso di sperimentare questo processo era disponibile per pochi eletti nel settore.

Questo è ciò che ha reso il rilascio di SORA da parte di OpenAI così significativo: hanno dimostrato che i trasformatori di diffusione potrebbero effettivamente gestire la generazione di video nonostante l’immensa complessità del compito.

Come i trasformatori di diffusione hanno risolto il problema dell’autoconsistenza nella generazione video

L’emergere dei trasformatori di diffusione ha affrontato diversi problemi: hanno consentito la generazione di video di risoluzione e lunghezza arbitrarie raggiungendo allo stesso tempo un’elevata autoconsistenza. Ciò è in gran parte dovuto al fatto che possono lavorare con lunghe sequenze, purché si adattino alla memoria, e al meccanismo di auto-attenzione.

Nell’intelligenza artificiale, l’autoattenzione è un meccanismo che calcola i pesi dell’attenzione tra gli elementi in una sequenza, determinando quanto ciascun elemento dovrebbe essere influenzato dagli altri. Consente a ciascun elemento di una sequenza di considerare tutti gli altri elementi simultaneamente e consente ai modelli di concentrarsi su parti rilevanti dei dati di input durante la generazione di output, catturando le dipendenze sia nello spazio che nel tempo.

Nella generazione video, ciò significa che ogni pixel in ogni fotogramma può correlarsi a ogni altro pixel in tutti i fotogrammi. Questa interconnessione garantisce che oggetti e personaggi rimangano coerenti durante l’intero video, dall’inizio alla fine. Se un personaggio appare in un fotogramma, l’autoattenzione aiuta a prevenire i cambiamenti e a mantenere l’aspetto di quel personaggio in tutti i fotogrammi successivi.

Prima, i modelli incorporavano una forma di auto-attenzione all’interno di una rete convoluzionale, ma questa struttura limitava la loro capacità di raggiungere la stessa consistenza e coerenza ora possibile con i trasformatori di diffusione.

Con l’attenzione spazio-temporale simultanea nei trasformatori di diffusione, tuttavia, l’architettura può caricare dati da diversi frame simultaneamente e analizzarli come una sequenza unificata. Come mostrato nell’immagine seguente, i metodi precedenti elaboravano le interazioni all’interno di ciascun fotogramma e collegavano ciascun pixel solo con la posizione corrispondente in altri fotogrammi (vedere Figura 1). Questa visione limitata ha ostacolato la loro capacità di catturare le relazioni spaziali e temporali essenziali per un movimento fluido e realistico. Ora, con i trasformatori a diffusione, tutto viene elaborato contemporaneamente (Figura 2).

Interazione spazio-temporale nelle reti di diffusione prima e dopo i trasformatori. Immagine fornita dall’autore

Interazione spazio-temporale nelle reti di diffusione prima e dopo i trasformatori. Immagine fornita dall’autore

Questa elaborazione olistica mantiene i dettagli stabili tra i fotogrammi, garantendo che le scene non si trasformino in modo imprevisto e si trasformino in un prodotto finale confuso e incoerente. I trasformatori di diffusione possono anche gestire sequenze di lunghezza e risoluzione arbitrarie, a condizione che si adattino alla memoria. Grazie a questo progresso, la generazione di video più lunghi è possibile senza sacrificare la coerenza o la qualità, affrontando sfide che i precedenti metodi basati sulla convoluzione non potevano superare.

L’arrivo dei trasformatori di diffusione ha rimodellato la generazione da testo a video. Ha consentito la produzione di video di alta qualità e coerenti con lunghezze e risoluzioni arbitrarie. L’autoattenzione all’interno dei trasformatori è una componente chiave nell’affrontare sfide come il mantenimento della coerenza del frame e la gestione di complesse relazioni spaziali e temporali. Il rilascio di SORA da parte di OpenAI ha dimostrato questa capacità, stabilendo un nuovo standard nel settore: ora, circa il 90% dei sistemi avanzati di conversione testo-video sono basati su trasformatori di diffusione, con attori importanti come Luma, Clink e Runway Gen-3 in testa al mercato. mercato.

Nonostante questi progressi mozzafiato, i trasformatori di diffusione sono ancora ad alta intensità di risorse, richiedendo quasi 10.000 volte più risorse di una generazione di una singola immagine, rendendo l’addestramento di modelli di alta qualità ancora un’impresa molto costosa. Tuttavia, la comunità open source ha compiuto passi significativi per rendere questa tecnologia più accessibile. Progetti come Open-SORA e Open-SORA-Plan, così come altre iniziative come Mira Video Generation, Cog e Cog-2, hanno aperto nuove possibilità per sviluppatori e ricercatori di sperimentare e innovare. Supportati da aziende e istituzioni accademiche, questi progetti open source danno speranza per un progresso continuo e una maggiore accessibilità nella generazione di video, a vantaggio non solo delle grandi aziende ma anche di creatori indipendenti e appassionati desiderosi di sperimentare. Questo, come qualsiasi altro impegno condotto dalla comunità, apre un futuro in cui la generazione di video è democratizzata, portando questa potente tecnologia a molti più creativi da esplorare.