Microsoft Corp. ha ampliato La sua linea PHI di modelli in linguaggio open source con l’introduzione di due nuovi algoritmi progettati per l’elaborazione multimodale ed efficienza hardware: Phi-4-Mini e Phi-4-Multimodal.

Caratteristiche Phi-4-Mini e Phi-4-Multimodal

Phi-4-Mini è un modello solo per testi che incorpora 3,8 miliardi di parametri, consentendole di funzionare in modo efficiente sui dispositivi mobili. Si basa su un’architettura del trasformatore solo decoder, che analizza solo il testo che precede una parola per determinarne il significato, migliorando così la velocità di elaborazione e riducendo i requisiti hardware. Inoltre, Phi-4-Mini utilizza una tecnica di ottimizzazione delle prestazioni nota come Attenzione a query raggruppata (GQA) per ridurre l’utilizzo dell’hardware associato al suo meccanismo di attenzione.

Microsoft Phi-4 AI affronta la matematica complessa con parametri 14b

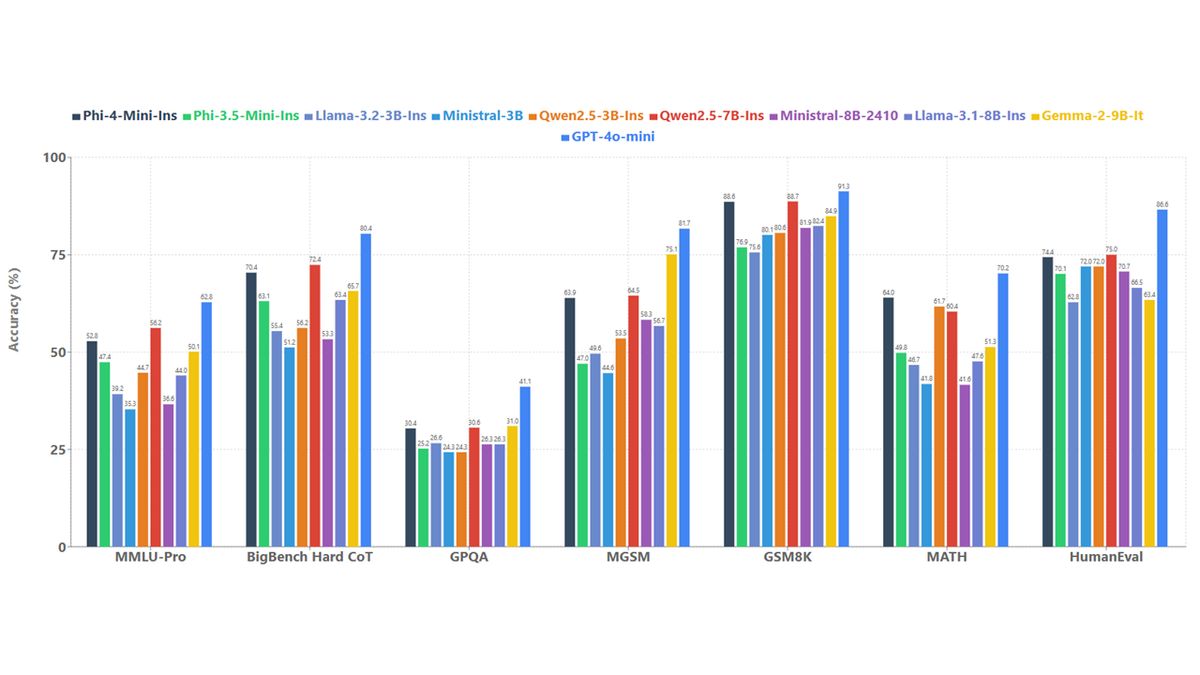

Questo modello è in grado di generare testo, tradurre documenti ed eseguire azioni all’interno di applicazioni esterne. Microsoft afferma che Phi-4-Mini eccelle in compiti che richiedono ragionamenti complessi, come calcoli matematici e sfide di codifica, ottenendo una precisione significativamente migliorata nei test di riferimento interni rispetto ad altri modelli di lingua di dimensioni simili.

Il secondo modello, Phi-4-Multimodal, è una versione migliorata di Phi-4-Mini, che vanta parametri di 5,6 miliardi. È in grado di elaborare input di testo, immagini, audio e video. Questo modello è stato addestrato utilizzando una nuova tecnica chiamata miscela di loras, che ottimizza le capacità del modello per l’elaborazione multimodale senza ampie modifiche ai pesi esistenti.

Microsoft ha condotto test di riferimento su Phi-4-Multimodal, dove ha guadagnato un punteggio medio di 72 nell’elaborazione dei dati visivi, appena timido del GPT-4 di Openi, che ha segnato 73. Google’s Gemini Flash 2.0 ha LED con un punteggio di 74,3. In compiti visivi e audio combinati, il flash Gemini-2.0 ha sovraperformato Phi-4-Multomedal “con un grande margine” e ha superato l’internomini, specializzato per l’elaborazione multimodale.

Sia Phi-4-Multimodal che Phi-4-Mini sono autorizzati con la licenza MIT e saranno resi disponibili attraverso Abbracciare la facciaconsentendo l’uso commerciale. Gli sviluppatori possono accedere a questi modelli Azure Ai Foundry E Catalogo API Nvidia per esplorare ulteriormente il loro potenziale.

PHI-4-Multimodal è particolarmente progettato per facilitare le interazioni naturali e attenti al contesto integrando più tipi di input in un singolo modello di elaborazione. Include miglioramenti come un vocabolario più ampio, capacità multilingue e una migliore efficienza computazionale per l’esecuzione sul dispositivo.

PHI-4-Mini offre prestazioni impressionanti nelle attività basate sul testo, comprese le capacità di ragionamento e di calcolo delle funzioni, consentendole di interagire con le interfacce di programmazione strutturate in modo efficace. La piattaforma supporta sequenze fino a 128.000 token.

Inoltre, entrambi i modelli hanno subito estesi test di sicurezza e sicurezza, guidati dal team interno di Ai Red (AIRT) di Microsoft, che ha valutato i modelli utilizzando metodologie di valutazione complete che affrontano le attuali tendenze della sicurezza informatica, equità e sicurezza degli utenti.

La personalizzazione e la facilità di implementazione sono ulteriori vantaggi di questi modelli, poiché le loro dimensioni più piccole consentono loro di essere perfezionati per compiti specifici con esigenze computazionali relativamente basse. Esempi di attività adatte per la messa a punto includono la traduzione del linguaggio e la risposta alle domande mediche.

Per ulteriori dettagli sui modelli e sulle loro applicazioni, gli sviluppatori sono incoraggiati a fare riferimento al Libro di cucina Phi Disponibile su GitHub.

Credito immagine in primo piano: Microsoft