Gloo ha annunciato una nuova serie di standard di fiducia e la formazione di un gruppo di consulenza di fiducia per promuovere le tecnologie di intelligenza artificiale allineate alla fiorente umana. Questa iniziativa fa parte della più ampia strategia di intelligenza artificiale aperta di Gloo, che include un accesso aperto a modelli di intelligenza artificiale, set di dati e ricerca per far avanzare lo sviluppo etico dell’intelligenza artificiale.

Stabilire standard di intelligenza artificiale per fiorimento umano

Il recentemente introdotto Standard fiorenti di ai (FAI) Valuta i modelli di intelligenza artificiale in sette dimensioni: relazioni, finanze, felicità, significato, carattere, salute e spiritualità. Queste dimensioni sono state sviluppate in collaborazione con il programma fiorente umano presso Harvard, Barna Group e altre organizzazioni basate sulla fede.

Per garantire risultati misurabili, Gloo sta lanciando il fiorente punto di riferimento dell’IA, un sistema che valuta i modelli di intelligenza artificiale utilizzando oltre 1.000 domande curate. Questo punto di riferimento mira a fornire una valutazione standardizzata dell’impatto dell’IA sul benessere umano.

“La fiducia nell’intelligenza artificiale è duplice: deve essere ad alte prestazioni, affidabili e sicure, allineando anche a valori etici che promuovono la prosperità umana collettiva”, ha affermato Pat Gelsinger, presidente di Gloo ed ex CEO di Intel.

L’iniziativa di Gloo è supportata dal Studio fiorente globaleuno sforzo di ricerca internazionale di cinque anni guidato da Harvard, Baylor University e Gallup. Questo studio, che copre 22 paesi e oltre 200.000 partecipanti, ha contribuito a modellare le dimensioni della fiorente umana ora utilizzata per la valutazione dell’intelligenza artificiale.

“Dopo anni di rigorose ricerche su ciò che supporta la prosperità umana, è promettente vedere queste intuizioni che modellano gli standard di valutazione dell’IA”, ha affermato Tyler Vanderweele, professore ad Harvard.

Inoltre, Gloo sta lavorando con organizzazioni di fede protestanti, cattoliche ed ecumeniche per garantire che le applicazioni di intelligenza artificiale si allineino ai principi etici e spirituali.

Per supervisionare l’implementazione di questi standard, Gloo ha stabilito a Trust Advisory Group composto da esperti in AI, sicurezza, privacy, legge, accademia e teologia. Il gruppo fornirà indicazioni sullo sviluppo etico dell’IA e aiuterà le aziende tecnologiche in linea con i valori centrati sull’uomo.

“Questi standard assicurano che l’IA non sia solo ad alte prestazioni, ma aiutano anche le persone a raggiungere il loro pieno potenziale”, ha affermato Scott Beck, CEO di Gloo.

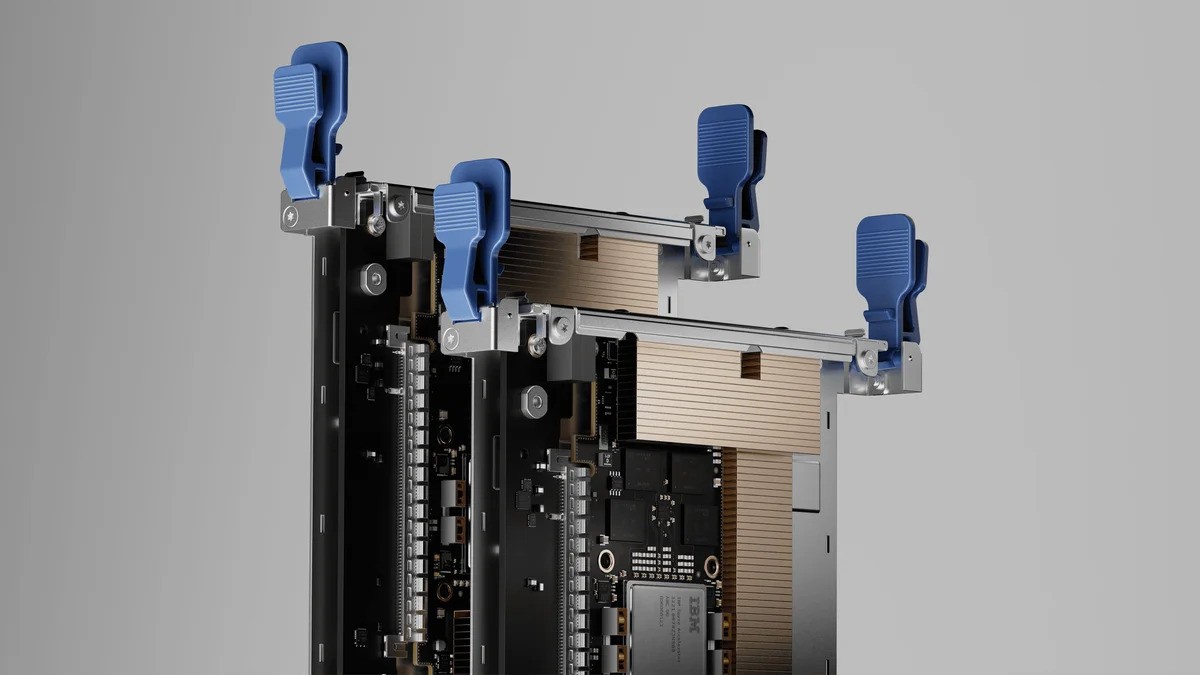

Credito immagine in primo piano: Gloo